在今年Google I/O大會上,谷歌展示了一款3D顯示、實時影片壓縮、空間音訊、計算機視覺、機器學習等技術的3D光場顯示方案:Project Starline。該方案的特點是,可顯示具有體積和深度的立體視覺,讓視訊通話體驗看起來更加生動,沉浸感更強。

近期,谷歌實驗室公佈了該專案背後的技術細節,包括採用的攝像頭、紅外感測器等硬體,以及如何在測試過程中,透過精準的視覺模擬來欺騙使用者的觀感。

簡單來講,Starline可以看做是一種專為面對面會議設計的雙向3D電話亭,它可以實時掃描使用者的3D形象,然後在另一端的光場顯示器上實時呈現立體的影片影象,這種立體影片裸眼可觀看,無需額外的頭顯。此外,聲音也以3D空間音訊形式呈現,通話者的注視點也會實時追蹤和更新,看起來足夠真實。

因此,使用兩個Starline方案,便可以實現多人遠端3D通話。由於Starline本身也是一個光場顯示屏,因此你可以從多個角度檢視影片中的通話者,彷彿那個人就在一片玻璃後面那樣,你們甚至可以實現對視。

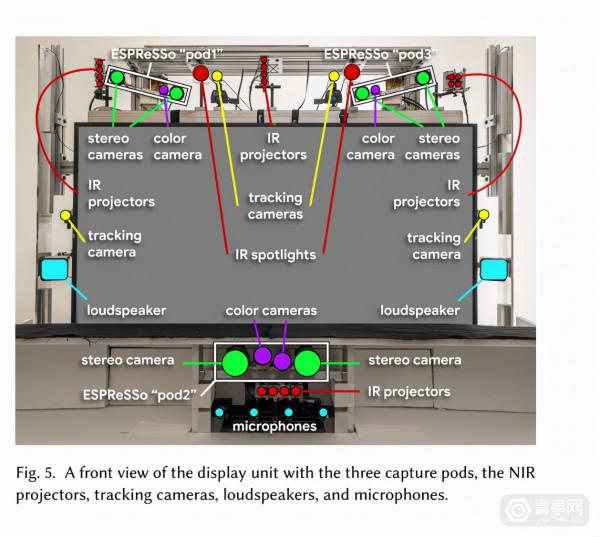

據青亭網瞭解,Starline包含三組立體雙攝像頭(每組包含一顆1600x1200 RGB攝像頭,以及一對1280x1024單色近紅外3D攝像頭),分別位於螢幕的下方和上方(左右兩側),此外還配備四個紅外投影儀模組,兩個紅外聚光燈,另外還有四個定位攝像頭(實時追蹤眼鏡、耳朵和嘴),四個RGB攝像頭(螢幕下方的一個RGB攝像頭對準脖子、面部和下巴,上方的攝像頭捕捉手勢、頭部和軀幹)。其中,Starline使用兩組立體攝像頭來捕捉使用者的面部和上半身形象,並實時生成3D模型。

配備如此多的感測器硬體,Starline的成本也很高,因此目前僅在谷歌內部使用。從5月以來,該方案在谷歌辦公室的使用規模越來越廣泛,累計測試時間長達數千小時,應用場景包括入職談話、面試、介紹新同事、探討業務、一對一協作等等。同時體驗者們也給出了積極反饋,尤其看好用Starline實現線上眼神交流的能力,並認為3D通話可以增強參與感,拉近任何人之間的距離。

初步測試表明,與傳統視訊通話相比,Starline改善了遠端通話的許多關鍵部分,比如注意力、記憶力和臨場感。一位體驗者認為,使用Starline來通話有點像是在咖啡廳聊天,可模擬逼真的面對面交流,通話的時候更容易靠近並關注對方。

3D影片支援更多非語言互動

經過對比2D視訊通話與Starline的效果,谷歌得到以下發現:

谷歌測量了數百名員工使用Starline的體驗,發現與傳統視訊通話相比,3D通話的感覺更像是兩人在一個空間。其他發現:

- 1)通話者使用更多非語言交流方式,比如手勢使用率提升40%,點頭頻率提升25%,眉毛做表情次數提升50%;

- 2)使用Starline通話後,體驗者回憶談話細節和回憶內容時,記憶力提升近30%;

- 3)在眼球追蹤實驗中,谷歌發現通話者對於說話人的注意力提升15%,也就是說3D通話有助於提升視覺注意力。

關於系統設計

谷歌透露,Starline的設計目標是:

- 高解析度、高幀率、色彩準確的真人大小影象;

- 具備立體視覺和視差,可同時為左右眼分別動態渲染影象,延遲足夠低;

- 對稱的影片體驗,可實現延伸交流;

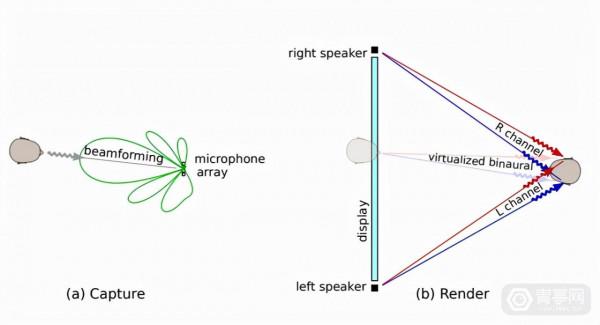

- 對稱的音訊體驗,音訊像是從說話人口中傳出;

- 無需眼鏡/頭顯、追蹤標記或領口麥克風;

- 用於長時間會議體驗感足夠舒適。

除了複雜的感測器設計外,Starline還採用了一種基於影象的全新幾何融合演算法,以及聲源定位系統、空間去混響技術。

谷歌表示:隨著遠端通訊技術發展,遠端通話變得更加保真、同步。目前,人們使用Zoom、Skype、FaceTime等應用進行視訊通話,但這種2D形式的影片缺少臨場感。未來,具有臨場感的通話技術有望拉近人與人之間的關係,為跨國企業、社會團體帶來更好的遠端通訊體驗。不過,具有臨場感的通話技術面臨三大挑戰,即:

1)捕捉並渲染遠端使用者的3D視聽影象,營造真假難辨的體驗感;

2)在具有視網膜解析度、高視場角、立體視覺和運動時差的顯示屏中,實時執行3D視聽內容;

3)營造臨場感,給遠端通話者一種在同一空間面對面說話、靠近、互動、對視的感覺。

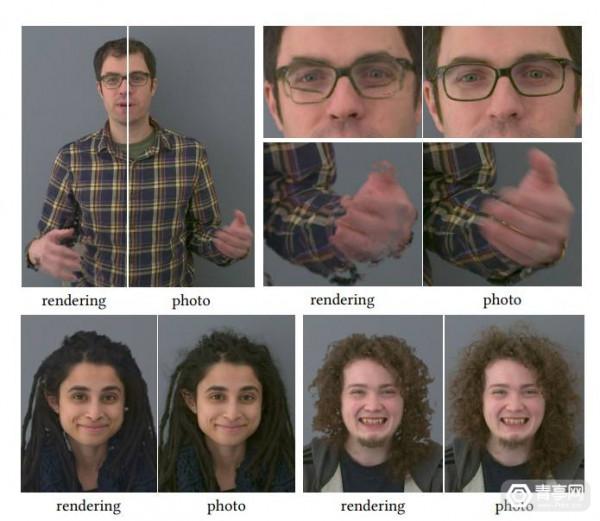

Starline還有效解決了3D影片可能存在的偽影等視覺問題。谷歌表示:就現有技術而言,一方面2D影片已經可以足夠清晰,而3D影片通常會出現偽影、視覺輻輳調節衝突等問題,而且解析度較低、追蹤延遲較高,因此3D通話體驗難以超越2D影片。

而Starline則透過進行涉及的物理佈局、照明、3D捕捉、色彩與深度影片壓縮、渲染、顯示和音訊子系統,來營造一種具有臨場感的3D通話效果,消除通話者之間的距離感。

此外,Starline首次採用基於頭部追蹤的串音消除技術,給人一種聲音反覆來自於遠端通話者嘴部的感覺。也就是說,聲音來源可以根據講話者的位置而移動。顯示方面,Starline利用基於影象的幾何融合演算法,將多種深度和色彩融合渲染。在3D人臉掃描部分,則是採用3D面部特徵追蹤系統,結合2D面部關鍵點預測、3D散焦測量以及雙層指數濾波,來準確預測3D面部資訊,取樣率可達120Hz。

更多細節

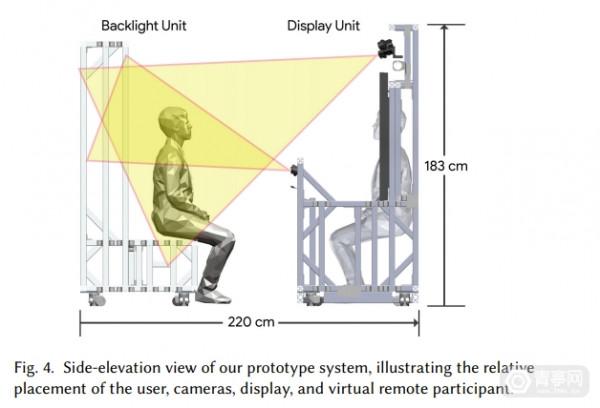

在3D視訊通話設計上,谷歌從多方面進行考量,他們認為相比於站立交流,坐著談話更舒適。而且,真人與虛擬影象之間的距離大約1.25米,正好在標準的個人空間和社交距離之間,因此可以適用於各類社交或會議場景。

谷歌還表示:沒有選擇用AR/VR來實現3D通話,部分原因是因為現有的頭顯技術還存在重量、舒適性等侷限,因此決定採用基於螢幕的系統,裸眼就能觀看3D。此外,市面上大多數VR頭顯的角解析度小於20畫素/度,而AR頭顯的視場角也不夠大,所以AR/VR頭顯無法在保證視場角同時顯示高解析度。

於是,谷歌採用了一種支援頭部追蹤的,65英寸8K裸眼3D螢幕,其特點是包含3310萬顆RGB畫素,重新整理率可達60Hz。這個8K顯示屏可滿足對於顯示面積,以及解析度的要求。另外,其角解析度越大45畫素/度(人眼與畫素距離1.25米時)。

計算單元採用兩個帶有PCle的聯想P920 PC,採用4個NVIDIA顯示卡(2個Quadro RTX 6000和兩個Titan RTX)。影片重新整理率達60Hz,面部追蹤和近紅外立體結構捕捉系統的重新整理率則分別為120Hz和180Hz。面部追蹤可識別34個面部節點,追蹤延遲約33毫秒。

儘管如此,谷歌認為Starline在顯示和捕捉半透明、輕薄幾何形狀(頭髮、眼鏡),或是深度凹陷、快速運動等效果時,可能會在重建深度圖中存在錯誤或漏洞,導致幾何圖形和紋理渲染錯誤。未來,還將在這些問題上進一步最佳化。此外,未來3D影片壓縮程度也將進一步提升,降低整體頻寬利用。

接下來,谷歌希望進一步開發Starline技術,並探索它對於遠端通話帶來的影響。也許,未來這項技術有望大幅最佳化遠端辦公場景,並在企業推廣。參考:谷歌