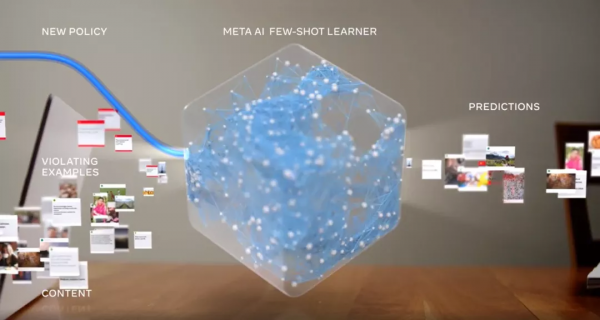

近日,Meta 研發出一款新的 AI 系統——Few-Shot Learner(FSL)。

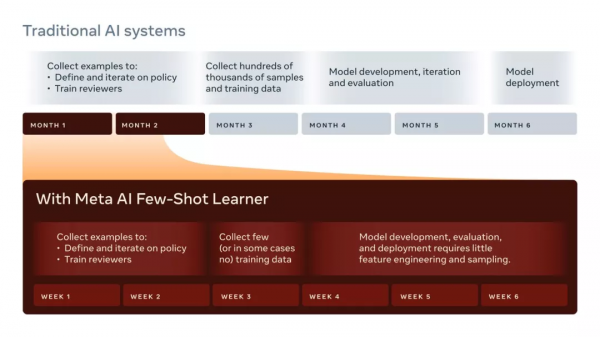

如今,網際網路上的一些有害內容演變速度非常快,而傳統 AI 系統通常需要花費幾個月的時間來收集和標記大量資料內容,然後才能識別一種新型別內容。這並不能滿足快速識別新型有害內容的需求。

Meta 則表示,FSL 可以更快地發現錯誤資訊,且只需要少量,甚至零的訓練資料。具體來說,其可以在幾周,而不是幾個月的時間內對新的或正在進化的有害內容進行有效識別。

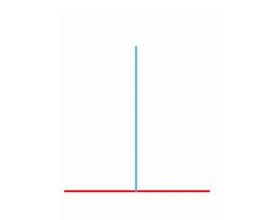

如果把傳統的 AI 系統比作捕魚線,那 FSL 好比一張漁網,可以捕獲各種型別的魚。

據悉,FSL 適用的語言可達到 100 多種,除了能從影象、文字等不同型別的資料中學習,還可以加強現有的 AI 模型。

目前,FSL 已被應用在 Facebook、Instagram 等平臺上。

與之前依賴於模式匹配帶標籤資料的AI系統不同,FSL 可以隱式學習策略文字。在解釋 FSL 的產生過程時,Meta 說,“其先接受了數十億個通用語言和開源語言示例的培訓,又接受了違反政策的內容和我們多年來標記的邊界內容的訓練,還學習瞭如何用簡潔的文字解釋新政策。”

圖 | 傳統 AI 系統和 Few-Shot Learner 的對比(來源:Meta)

Meta 進一步說,“由於在自我監督學習技術和新的超高效的基礎設施領域的突破,使得我們可以從傳統的、定製的 AI 系統轉向更大的、更加統一的系統,從而減少對標記資料的依賴。”

據瞭解,FSL 用到了一種少樣本學習方法(Few-Shot Learning)。

Meta 將自己提出的方法與幾種現有較先進的小樣本學習方法進行了比較,並透過一系列的系統評價,結果表明,Meta的方法效率可以比其他方法高出 55%(平均高 12%)。

Meta 表示,FSL 是一種大規模、多模式、多語言、零樣本或少樣本 AI 模型,其能夠實現聯合策略和內容的理解。“我們正在積極開展研究,以培訓使用簡單的帶有某種策略的語句,而不是成百上千帶標籤的例子的模型。”

FSL 主要是在零樣本、少樣本演示和具有微調的低樣本場景中工作,每個場景都需要不同級別的標記示例。

FSL 的總體輸入包括三個部分。首先,其從整個帖子中學習多模態資訊,包括文字、影象、 URL 等。之後,分析與策略相關的資訊,比如策略的定義,或者標記示例來表明某個特定的帖子是否違反了策略定義。最後,如有必要,可將其他帶有標籤的示例作為示範。

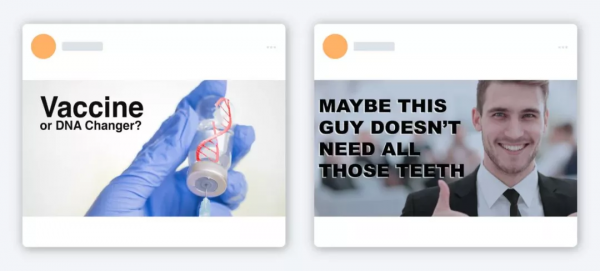

在一些相對較新的事件上,Meta 對 FSL 進行了測試。其最近的一項任務就是識別那些有誤導性或聳人聽聞的資訊,併成功阻止了大量反新冠疫苗(例如,“疫苗或 DNA 改變者?”)的帖子。

在另一個單獨的任務中,FSL 改進了一個現有的分類器,可以標記接近於煽動暴力的內容,例如,“那個傢伙需要他所有的牙齒嗎?”而傳統的方法可能已經錯過了上述型別的帖子。

Meta 還透過標準化的離線和線上 A/B 測試協議來衡量 AI 模型的效能。其研究了 FSL 在 Facebook 和 Instagram 上推出前後,有害內容分別的流行程度。簡單來說,即人們看到的有害內容的百分比變化。

研究表明,FSL 能夠正確地檢測到傳統 AI 系統可能遺漏的帖子,並幫助減少這些有害型別內容在社交平臺上的傳播。而且,結合現有的分類器,FSL 還有助於減少仇恨言論等內容的流行。

“我們正在進行額外的測試,以改進分類器,使其能夠從更多的標記訓練資料中受益,就像那些在沒有大量標記訓練資料的語言國家中那樣,我們將繼續在新出現的違規內容模式中進行測試。”Meta 說道。

不過,現在智慧化、通用化 AI 模型還處於早期發展階段,到其能夠理解幾十頁的政策文字並立即知道如何執行之前,還有很長的路要走。

對於沒有大量標記培訓資料的內容型別,快速執行的能力可以使 FSL 變得更加靈活,從而輕鬆應對各種新出現的挑戰。

Meta 在少樣本學習和零樣本學習等尖端 AI 領域已經進行了大量研究和投資。其相信,隨著不斷髮展,未來 FSL 可以透過所有完整的 AI 系統,利用單一的、共享的知識庫,來處理眾多不同型別的違規內容,從而彌補人類洞察力和分類器的不足。

Meta 同時表示,像 FSL 這樣的成長型 AI 系統,可以顯著提高其分辨新興狀況的敏捷性,並透過更快、更準確地識別不斷變化的有害內容,來營造一個更良好的社群氛圍。

-End-

參考:

https://ai.facebook.com/blog/harmful-content-can-evolve-quickly-our-new-ai-system-adapts-to-tackle-it