(映維網 2021年12月20日)在進行視訊通話時,任何頭戴式顯示器系統都必須克服的一個基本問題是:如何呈現使用者的完整面部。挑戰在於,頭顯遮蔽面部,尤其是眼睛;使用者通常是可以移動;以及使用者不在合適的捕獲裝置的視場範圍內。

在名為“Computing images of head mounted display wearer”的專利申請中,微軟介紹了一種利用機器學習裝置來計算補充完整使用者面部影象的方法和系統。

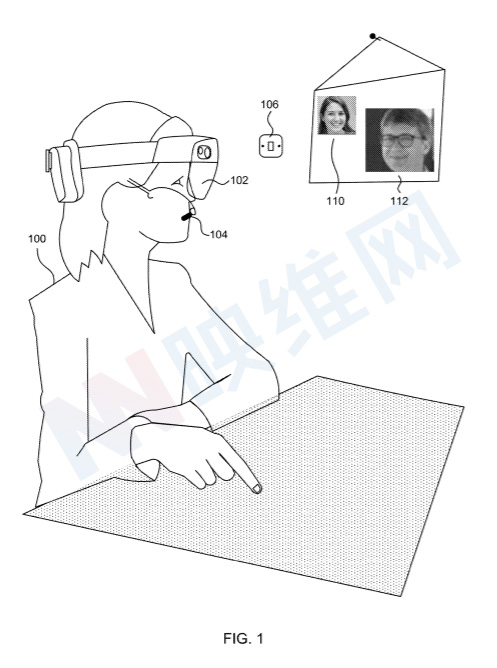

圖1是佩戴頭顯102並參與視訊會議呼叫的人員100的示意圖,其中遠端方112將所述人員感知成沒有佩戴頭顯時的形象。

在一個實現中,圖1中的示例涉及非對稱頭顯影片呼叫,其中遠端方112可以使用傳統顯示器,例如帶有整合網路攝像頭的膝上型電腦。遠端方112從本地使用者接收虛擬網路攝像頭流,其中使用者100可以描述為沒有佩戴頭顯時的形象,並且其面部表情與使用者100的真實面部表情匹配。虛擬網路攝像頭的視點是根據使用者偏好預先配置或設定。

在圖1的示例中,存在兩個額外的面向面部的捕獲裝置,但由於它們被HMD主體遮擋,因此不可見。兩個附加的面部面向捕獲裝置包括第一眼睛面向捕獲裝置和第二眼睛面向捕獲裝置。第一和第二眼睛面向捕獲裝置可以分別是面向右眼的捕獲裝置和麵向左眼的捕獲裝置,並且可以是紅外捕獲裝置。第一和第二眼睛面向捕獲裝置的視場佈置成包括眼睛本身、鼻子的一部分以及眼睛周圍的臉頰區域。

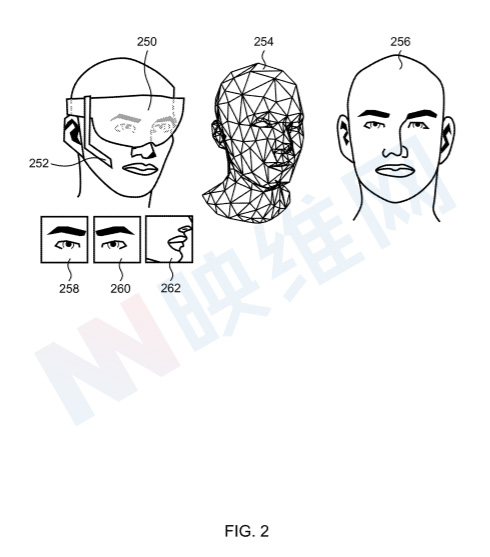

如圖2所示,在臂架104中,由面向左眼的捕獲裝置捕獲的影象258、由面向右眼的捕獲裝置捕獲的影象260和由捕獲裝置捕獲的影象262都是在同一時間間隔內拍攝。注意,每個面部捕捉裝置都具有面部的區域性檢視,並且無法獲得面部的完整檢視。

由於頭顯本身遮擋了佩戴者的大部分面部,因此不可能使用捕獲裝置獲得面部的完整檢視。由於頭顯和佩戴者面部之間的空間很小,因此無法從頭顯內的視角觀察佩戴者的整個面部,因此有必要進行預測判斷。可用於進行預測的觀測資料來源包括來自面部捕捉裝置的經驗觀測感測器資料。

可以發現,使用三個具有面向面部的捕捉裝置可以獲得特別好的結果。這是因為眼睛和口腔區域對於預測頭顯使用者的表情非常重要。

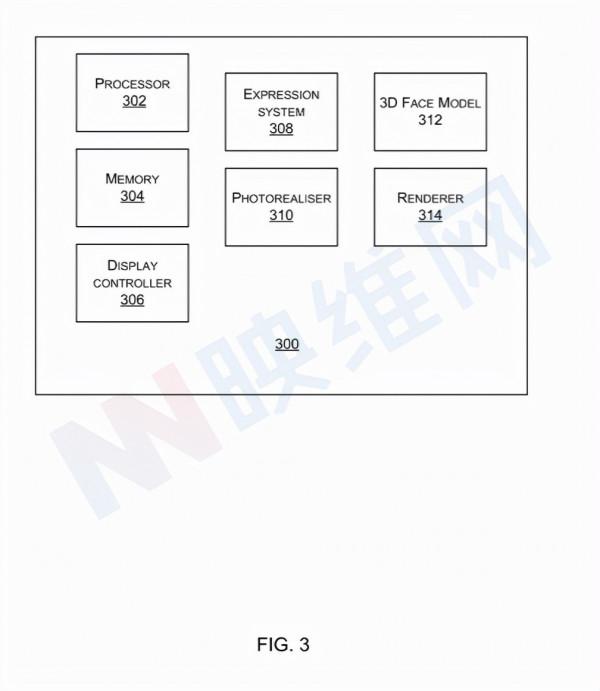

圖3是用於計算使用者面部影象的裝置300的示意圖。在某些情況下,圖3的裝置與頭顯整合。在其它情況下,所述裝置遠離HMD,例如在伴隨計算裝置中或在雲服務部署中。伴隨計算裝置是物理上接近頭顯並且與頭顯有線或無線通訊的計算裝置。伴隨計算裝置的例子有智慧手機、智慧手錶和膝上型電腦等

所述使用者面部影象計算裝置包括至少一個處理器302、儲存器304和顯示控制器306,後者控制頭顯對一個或多個虛擬物件的顯示。所述裝置進一步包括表情系統308,表情系統308將由至少一個面部捕捉裝置捕捉的感測器資料作為輸入,並計算表情引數的輸出值。所述表情系統包括機器學習模型,機器學習模型經訓練以從輸入影象計算表情引數。照片校準器310是經訓練以將從3D面部模型渲染的影象對映到照片級真實感影象的機器學習模型。

所述裝置包括具有引數的三維面部模型312。在一個實施例中,3D面部模型312具有標識、表情和姿勢引數。標識引數指定三維人臉模型的例項化所代表的個人。表情引數指定三維人臉模型的形狀和外觀。姿勢引數指定三維人臉模型的可移動元件的位置和方向,如頜骨、頸部骨骼、眼球、舌頭。姿勢引數的值是使用來自一個或多個捕獲裝置的資料推斷出來。

在某些情況下,眼睛姿勢和下巴姿勢是使用眼睛和臂架攝像頭的輸出確定。可以使用僅包含表情引數的三維人臉模型,例如在預配置姿勢和標識引數的位置,或者在不需要移動下巴和眼睛的位置。所述裝置同時包括渲染器314,其用於渲染來自3D面部模型312的影象。渲染器是用於渲染來自3D模型的影象的任何裝置,例如商用計算機圖形渲染器,其使用光線追蹤和關於虛擬camera的視點的資訊來渲染影象。

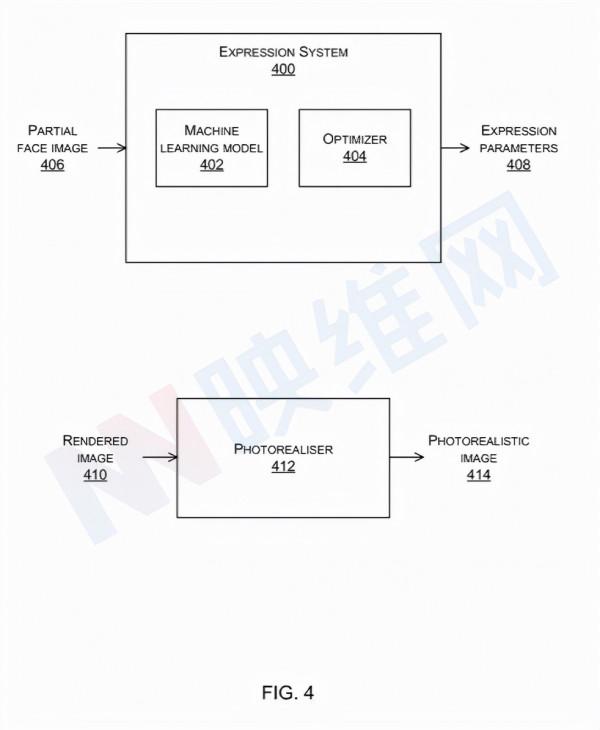

諸如圖3的表情系統400包括機器學習模型402和最佳化器404。經過訓練的機器學習模型是神經網路,或任何其他合適型別的機器學習模型。在一個示例中,表情系統400的機器學習模型402已經使用了描述頭顯使用者面部區域性檢視的合成影象進行訓練,合成影象與已知表情引數相關。

在一個示例中,透過從引數化面部模型取樣、將表情應用於取樣的引數化面部模型、新增虛擬頭顯和虛擬照明、從虛擬頭顯中的一個或多個面部捕捉裝置的視點渲染來生成合成影象。

在一個示例中,引數化面部模型是由多個單獨模型形成的複合模型。各個模型包括一個或多個:幾何模型、紋理模型、頭髮模型和眼睛顏色模型。幾何模型基於線性身份和表達基礎,採用線性混合蒙皮控制眼睛、下巴和頭部運動。為了從幾何模型中取樣,可以使用高斯混合模型。

紋理模型由反照率紋理和置換紋理組成。反照率紋理表示膚色,而置換表示褶皺和孔隙水平置換。頭髮模型由定義頭髮、眉毛和鬍鬚的各個髮束的曲線組成。眼睛顏色模型是基於示例的眼睛顏色取樣器。

可以對上述各個模型進行單獨取樣,以獲得可渲染的完整人臉標識。

面部設定完成後,將頭顯模型以遮擋感知的方式放置在合成頭部。放置基於平均頭部形狀的手動放置,如果裝置與頭部相交,則調整平均頭部形狀。

為了模擬面向嘴巴的攝像頭的照明和背景物件,高動態範圍影象(HDRI)可用作場景的照明和背景。從庫中為每個場景取樣不同的HDRI,並可以選擇每n幀旋轉一次HDRI,以模擬頭部旋轉和背景運動。要對人臉捕捉裝置進行建模,需要使用焦距、景深和解析度來匹配頭顯真實人臉捕捉裝置的屬性。

表情系統的機器學習模型402使用帶損失函式的監督訓練進行訓練,所述損失函式是訓練示例的預測表情引數值和已知表情引數值之間差異的度量。在一個例子中,機器學習模型是一個卷積神經網路,並使用反向傳播進行訓練。

在各種示例中,表情系統神經網路的設計使得可以從大量不同的使用者群體中以一般方式進行訓練,然後適應具有最少資料的個人。

照片校準器412是一種機器學習模型,它將渲染影象410對映到照片級真實感影象414。可以使用成對的資料對光校準器的機器學習模型進行訓練,每對資料包括從攝像頭捕獲的照片,並描繪具有表情的真實人員的正面檢視,以及配置與表情對應的引數值時從3D人臉模型渲染的影象。

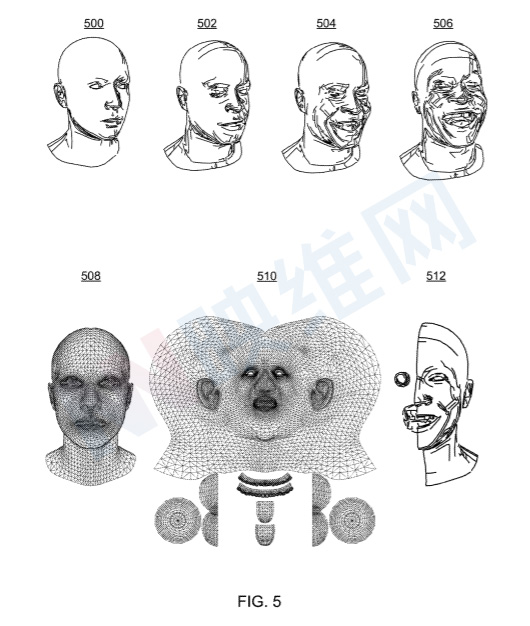

圖5是具有中性姿勢和中性表情的普通人的模板網格500,其中顯示模板網格覆蓋有光滑表面。首先基於個體的身份對模板網格500進行變形,以建立圖5的502中所示的結果,結果是具有中性表情的特定個體的面部的三維模型。使用基於表情引數值的第二變形來變形圖5的502中的結果,以給出圖5的504中所示的結果,結果表示與502中相同的個體,但具有微笑和閉著眼睛的表情。當姿態引數的值新增時,結果顯示在圖5的506中,其中頭部向後傾斜,頭部向右轉動,下巴開啟。姿勢引數設定眼睛以及頸部和下巴骨骼的姿勢。

普通人的模板網格500旨在作為所有人臉的平均值,並有助於將專利所述技術泛化到不同的個人。

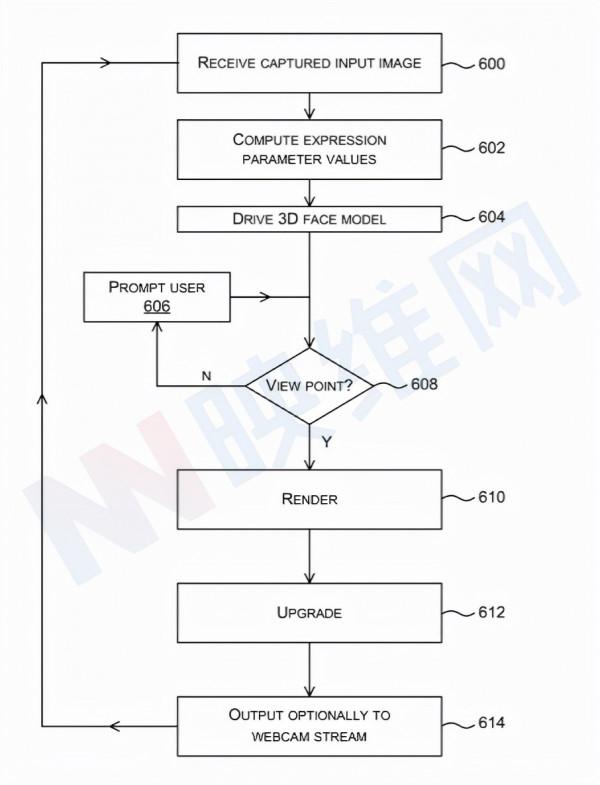

圖6是用於計算頭顯使用者面部影象的裝置的操作方法的流程圖。簡單來說,首先從至少一個面向面部的捕獲裝置接收捕獲的輸入影象,然後再交由機器學習裝置來計算補充被輸入影象中被頭顯遮擋的部分,從而呈現完整的人臉影象。

相關專利:Microsoft Patent | Computing images of head mounted display wearer

名為“Computing images of head mounted display wearer”的微軟專利申請最初在2020年6月提交,並在日前由美國專利商標局公佈。