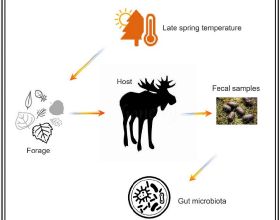

自組織反向傳播(SBP)機制可以在降低計算能耗的同時不損失精度。圖片來源:unsplash

■記者 張雙虎

雲計算、大資料、人工智慧等技術的快速發展和廣泛應用,讓這些領域成了“電老虎”。新思界產業研究中心《2021年全球及中國資料中心加速器產業深度研究報告》預測,到2025年,僅全球資料中心消耗的電能就將佔全球總髮電量的五分之一。

近日,中科院腦智卓越中心研究員徐波、蒲慕明院士聯合研究團隊線上發表於《科學進展》的研究,利用介觀尺度自組織反向傳播(SBP)機制,在更高效率、更靈活的類腦區域性學習方面取得了重要進展。該技術能在機器學習過程中,降低計算能耗的同時又不損失精度,讓這些“電老虎”可以少吃多幹。

能耗的瓶頸

人工智慧在某些領域表現出巨大的優勢,比如,AlphaGo 完勝人類世界圍棋冠軍;在電子遊戲競技中,AlphaStar以10:1的總比分“狂虐”職業玩家。

近年來,隨著資料量越來越大、算力越來越強、大規模預訓練模型對能源的要求也越來越高。據倫敦大學學院教授David Attwell團隊透過對單個神經元耗能進行計算,發現整個大腦的能耗約16.6瓦。對於人體而言,大腦只需要不到20瓦的功率就可以應對複雜思考任務。與之相比,戰勝柯潔的AlphaGo,耗電量相當於12760個人類大腦。

“預訓練模型的引數提高以後,人工智慧的效能確實更強了,但能耗問題也不容忽視。”該論文第一作者、中國科學院自動化所副研究員張鐵林對《中國科學報》說,“研究者普遍認為,人工智慧的表現還應更好一些。比如,進行同樣運算而消耗更少的能源。”

模擬人類大腦執行過程是人工智慧的一個重要途徑,在人工智慧研究領域,目前神經網路中被廣泛使用的反向傳播演算法(BP)採用全域性最佳化策略。這種端到端的學習方法效能卓越,但學習過程能量消耗大,缺乏靈活性。

“在精度不受影響的前提下,降低能耗是我們的研究目的之一。”徐波告訴《中國科學報》,“現在包括人工智慧大模型在內的很多演算法也遠未達到人腦的引數量。而大腦維持這麼多神經元運算,卻是非常節能的。如果我們在演算法設計之初,讓機器能像人那樣去學習,也許模型不必那麼龐大,學習訓練的時候也不會那麼耗電。”

向大腦學習

“我們想借用一些生物學領域取得的進展,弄清楚大腦是怎麼在低能耗的情況下高效學習的。”張鐵林說,“所以蒲慕明老師給徐波老師團隊推薦了很多演算法,並保持著深度合作。”

1997年,蒲慕明團隊在《自然》雜誌發表論文,揭示了海馬體內神經元可以將長時程抑制(LTD)可塑性自組織地傳播到三個方向,分別是突觸前側向傳播、突觸後側向傳播和反向傳播,這個發現就是SBP。

進一步的研究證實,SBP現象具有普遍性,不僅覆蓋更多的神經區域如視網膜—頂蓋系統,還覆蓋更多的可塑性型別,如長時程增強。該機制的形成歸結於生物神經元內分子調製訊號的天然逆向傳遞,被認為是可能導致生物神經網路高效反饋學習的關鍵。

研究團隊受到該機制的啟發,對SBP的反向傳播方向(第三個方向)單獨構建數學模型,重點描述了神經元輸出突觸的可塑效能夠反向傳播到輸入突觸中,可塑性的發生可以透過時序依賴突觸可塑性,也可以透過人工區域性梯度調節。在標準三層脈衝神經網路(SNN)的學習過程中,SBP機制可以自組織地完成前一層網路權重的學習,並可以結合短時突觸可塑性、膜電位平衡等,形成更強大的SNN組合學習方法。

由於涉及前沿生物技術,有很多生物機制計算機驗證起來非常困難。

“蒲老師講完這一機制,我們讀相關論文時還覺得這項工作並不複雜。”張鐵林說,“但真正應用到模型上卻困難重重、一籌莫展。”

張鐵林等人是計算機領域的,生物領域論文對他們來說比較難,“很多時候並不完全懂”。而且,大腦中有多個關聯機制,要不要跟SBP結合、怎麼結合、神經元的突觸往前傳多少、傳給誰、有沒有傾向性,這些問題都沒有答案,感覺“有很多缺失的資訊需要去補充”。

沒有標準答案,研究人員只能先結合網路情況進行論證分析,再設定一個可最佳化的引數,用一些特殊的方法構建“能量函式”來約束一些變數,然後把這個機制放到脈衝網路裡去驗證。

然而,經過多次嘗試,結果卻並不理想。他們只好回過頭來重新認識“生物學規則”。隨著學習的深入,蒲慕明建議他們做一些小實驗來模仿類似生物的小網路。慢慢的,這種機制逐步明確起來。

“從科研角度來講,要先做減法,把它的重要性弄清楚、體現出來,後面再做加法,加更多的機制、變數和條件。”張鐵林說,“目前我們只是在一些標準的簡單模型上進行了驗證。因為如果模型太複雜,會說不清楚SBP在其中到底貢獻了什麼。下一步我們會在更大規模的模型上進行驗證。”

研究團隊針對性地提出一種統計訓練過程中能量消耗的新方法。在圖片分類、語音識別、動態手勢識別等多類標準資料集上,SBP機制透過組合其它可塑性機制,實現了更低能耗和更高精度的SNN區域性學習。在一些人工網路的學習中,SBP機制也可以大量替換BP機制實現全域性和區域性交叉學習,在降低計算能耗的同時不損失精度。

“自組織”的優勢

“生物智慧計算的本質,很可能就是靈活融合多類微觀、介觀等可塑性機制的自組織區域性學習,結合遺傳演化賦予的遠端投射網路結構,達到高效的全域性最佳化學習效果。”蒲慕明告訴《中國科學報》,“該工作可以進一步引導生物和人工網路的深度融合,最終實現能效比高、可解釋性強、靈活度高的新一代人工智慧模型。”

目前,反向傳播機制已經是一種最佳化的結果,作為一種標準模型,它基本上覆蓋了脈衝和人工網路模型,效果也不錯。

“但其能耗和學習效率方面,還可以再最佳化一些,從各個尺度上再提升一下。”張鐵林說,“我們在訓練時,也採取混合式的訓練方法,一部分採用BP方法,一部分採用SBP方法。”

研究人員認為,SBP是一類介觀尺度的特殊生物可塑性機制,具有自平衡、自組織、可傳播等特點,因此在神經網路學習中展示出較好的組合最佳化優勢。

“人工的反向傳播演算法靠整體目標函式驅動,每次計算時既慢又耗能,特別是在網路比較大的時候,問題就更明顯了。”張鐵林說,“如果一個演算法是自組織的,它就可以像大腦一樣無監督學習,可以進行區域性運算,就比較節能了。”

目前,該團隊已經在一些小型、淺層的人工網路上做過測試。結果表明,最好的時候,其可以在保持原來效能的基礎上,把能耗降到原來的21%左右。

“比如,原來需要100塊GPU去訓練,現在只需要21塊就夠了。”張鐵林說,“這在進行大模型訓練的時候就比較重要了。”

SBP只是一個開始,它對進一步深入探索類腦區域性計算具有很大的啟示。

“將來還有很多和腦智卓越中心生物科學團隊的交叉合作研究。”徐波說,“相信人工智慧領域未來還有很大的進步空間,這些受生物啟發的學習法則可以幫助人們更好地填補這些空白。”