作者 | ZeR0

編輯 | 漠影

芯東西11月9日報道,今日,人工智慧及高效能計算頂級技術盛會NVIDIA GTC大會如約而至。

這個市值已高達7700億美元的AI頂級玩家,剛剛推出全球最小、功能強大、能效最高的下一代AI超級計算機NVIDIA Jetson AGX Orin,其算力達到200TOPS,可與內建GPU的伺服器媲美。

在下午的虛擬主題演講中,NVIDIA創始人兼CEO黃仁勳穿著熟悉的皮衣,公佈了一系列最新AI技術和產品,並推出承載著其“元宇宙”願景的全新虛擬化身平臺。

由這個平臺生成的“迷你玩具版黃仁勳”Toy-Me,能與人自然地問答交流。

在幫助企業降低AI開發部署門檻方面,NVIDIA可以說是做到了極致,比如提供方便企業構建AI大模型的框架,以及定製專屬聲音的虛擬助手。

黃仁勳說,NVIDIA開發者數量已接近300萬,CUDA過去15年下載量達3000萬次,一年下載量達到700萬。

此外,NVIDIA繼續表露對醫療健康領域的熱情,推出搭載新一代Orin晶片、無縫連線醫療裝置和邊緣伺服器的AI計算平臺Clara Holoscan。

黃仁勳還宣佈,NVIDIA將構建一個數字孿生模型來模擬和預測氣候變化,數字孿生將名為E-2,即Earth Two,地球的數字孿生,能夠在虛擬世界模擬引擎Omniverse中以Million-X百萬倍的速度執行。

一、Jetson AGX Orin:手掌大小,算力堪比伺服器

自2014年推出Jetson TK1至今,NVIDIA Jetson系列已經積累了85萬名開發者。

今日,NVIDIA推出全球最小、功能強大、能效最高的新一代AI超級計算機NVIDIA Jetson AGX Orin,用於機器人、自主機器、醫療器械和其他形式的邊緣嵌入式計算。

Jetson AGX Orin保持了與前代機型Jetson AGX Xavier相同的外形尺寸和引腳相容性,處理能力提升6倍,每秒算力達200TOPS,可與內建GPU的伺服器相媲美,而尺寸只有手掌那麼大。

它採用NVIDIA Ampere架構GPU、Arm Cortex-A78AE CPU以及新一代深度學習和視覺加速器。高速介面、更快的儲存頻寬和對多模態感測器的支援,為多個並行AI應用流水線輸送資料。

與歷代Jetson計算機一樣,使用Jetson AGX Orin的客戶可以運用NVIDIA CUDA-X加速計算棧、NVIDIA JetPack SDK和最新NVIDIA工具進行應用開發和最佳化,包括雲原生開發工作流程。

來自NVIDIA NGC目錄的預訓練模型已經過最佳化,並可以使用NVIDIA TAO工具套件和客戶資料集進行微調。這減少了生產級AI的部署時間和成本,而云原生技術實現了產品整個生命週期內的無縫更新。

DRIVE AGX Orin同樣由Jetson AGX Orin等 NVIDIA Ampere架構提供支援,它是新發布的NVIDIA DRIVE Concierge和DRIVE Chauffeur背後的先進處理器,這兩個AI平臺分別為安全的自動駕駛提供動力。

針對特定用例的軟體框架包括用於機器人技術的NVIDIA Isaac Sim,用於自動駕駛的NVIDIA DRIVE,用於智慧城市的NVIDIA Metropolis。最新的Isaac版本包括對機器人作業系統(ROS)開發人員社群的重要支援。

NVIDIA還發布了用於Isaac Sim的全新NVIDIA Omniverse Replicator,用於為機器人生成合成訓練資料。這些硬體加速軟體包使ROS開發者更容易在Jetson平臺上構建高效能AI機器人。

NVIDIA Jetson AGX Orin模組和開發者工具包將於2022年第一季度上市。

黃仁勳還在演講中談道:“到2024年,絕大多數新款電動汽車將具備強大的自動駕駛能力。”

他展示了一個新自動駕駛平臺DRIVE Hyperion 8 GA,這是2024年模型的架構。其感測器套件包含12個攝像頭、9個毫米波雷達、12個超聲波雷達和1個前向鐳射雷達,所有這些都由2顆NVIDIA DRIVE Orin晶片來進行處理。

據他透露,目前,英偉達已經在全球各地收集到了PB級的道路資料,並擁有大約3000名訓練有素的標記員,建立訓練資料。儘管如此,合成數據仍是NVIDIA資料策略的基石。

二、NeMo Megatron:讓企業開發自己的大模型

為了方便企業開發部署大型語言模型,NVIDIA推出了為訓練具有數萬億引數的語言模型而最佳化的加速框架NeMo Megatron。

NVIDIA NeMo Megatron是Megatron的基礎上發展起來的。Megatron是由NVIDIA研究人員主導的開源專案,研究大型Transformer語言模型的高效訓練。Megatron 530B是全球最大的可定製語言模型。

利用先進的資料、張量和管道並行化技術,它能使大型語言模型的訓練有效地分佈在成千上萬的GPU上。

企業可以透過NeMo Megatron框架,進一步訓練它以服務新的領域和語言。經最佳化,該框架可以在NVIDIA DGX SuperPOD的大規模加速計算基礎設施上進行擴充套件。

除了NeMo Megatron外,NVIDIA還推出了一個開發Physics-ML模型的框架NVIDIA Modulus。

它使用物理原理及源自原理型物理和觀測結果的資料訓練Physics-ML模型,支援多GPU多節點訓練,由此生成的模型,其物理模擬速度比模擬快1000-100,000倍。

科學家可藉助Modulus建立數字孿生模型,來解決預測氣候變化等重要科學問題。

例如研究人員利用歐洲中期天氣預報中心的ERA5大氣資料訓練Physics-ML模型,該模型在128個A100 GPU上訓練需要4小時,訓練後的模型能以30公里的空間解析度預測颶風嚴重程度和路徑。

原本需要7天才能完成的預測,現在在一個GPU上只需0.25秒,比模擬快了10萬倍。

為了幫助企業加快AI之旅,NVIDIA宣佈在全球範圍內擴充套件其LaunchPad計劃,它允許使用者即時訪問在加速基礎設施上執行的NVIDIA AI軟體。企業可使用NVIDIA LaunchPad免費體驗開發和部署大型語言模型。

LaunchPad計劃由Equinix服務支援,包括資料中心、連線和裸金屬產品,獲得LaunchPad體驗後,企業可以在全球Equinix地點執行其NVIDIA加速的人工智慧工作負載。

三、Riva定製語音:快速建立定製版品牌聲音

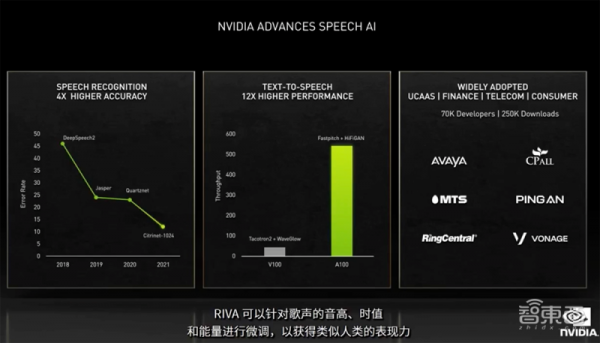

NVIDIA的Riva語音AI軟體同樣有了新進展,黃仁勳宣佈了該軟體一個新功能——Riva定製語音。

Riva可識別英語、西班牙語、德語、法語、日語、普通話和俄語等7種語言,可以生成隱藏字幕、翻譯、摘要、回答問題並理解意圖。

只需訓練30分鐘的音訊資料,企業即可構建屬於自己品牌大使的聲音,獲得類似人類的表現力。

也就是說,使用者根據特定的領域或行業術語,可以量身定製擁有獨特聲音的虛擬助理。

不到三年間,NVIDIA的對話AI軟體已被下載超過25萬次,並被廣泛採用到各個行業。

對於小規模研發,NVIDIA NGC容器登錄檔免費提供NVIDIA Riva,開發者可加入Riva開放測試版程式來試用該軟體。

對於擁有大規模部署並尋求NVIDIA專家技術支援的客戶,NVIDIA宣佈了NVIDIA Riva Enterprise計劃,該計劃預計將於明年初推出。

四、Omniverse Avatar:構建生動的智慧虛擬化身

虛擬助手的下一步,是擁有常識、推理能力和生動的視覺形象。

在GTC大會上,黃仁勳宣佈推出一個全方位的虛擬化身平臺——Omniverse Avatar。

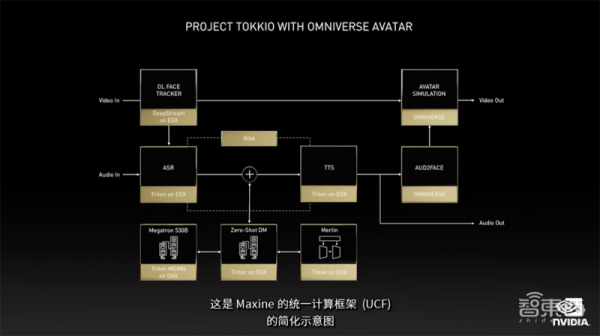

它是NVIDIA一系列先進AI技術的集大成者,將Metropolis的感知能力、Riva的語音識別能力、Merlin的推薦能力、Omniverse的動畫渲染能力等交匯於一體。

這使得開發者能構建出一個完全互動式的虛擬化身,它足夠生動,能對語音和麵部提示做出反應,能理解多種語言,能給出智慧的建議。

黃仁勳展示了一些例子。

比如,其玩偶複製品可以跟人對答如流。

Metropolis工程師用Maxine建立了Tokkio智慧操作檯應用程式,讓操作檯具有高度互動性,可快速做出對話響應。

在餐廳,兩名顧客點餐時,一個客戶服務虛擬化身可以跟他們交談和理解他們的需求。

這些演示由NVIDIA AI軟體和Megatron 530B提供支援,Megatron 530B是目前世界上最大的可定製語言模型。

在DRIVE Concierge AI平臺的演示中,中央儀表板螢幕上的數字助理,可幫助司機選擇最佳駕駛模式,使其按時到達目的地,然後在汽車續航里程下降到100英里以下時,按他的請求設定提醒。

藉助Maxine,這個人的話不僅被轉錄,還能以相同的聲音和語調被實時轉換成德語、法語等多種語言。

Maxine使用計算機視覺來追蹤人的面部,並識別其表情,3D動畫可為其製作虛擬而逼真的頭像。

可以想象,在企業和開發人員中,每個行業都需要某種形式的虛擬化身。

使用Omniverse Avatar平臺,你可以為視訊會議和協作平臺、客戶支援平臺、內容建立、應用收益和數字孿生、機器人應用等等構建定製的AI助理。

NVIDIA的虛擬世界模擬引擎Omniverse是打造虛擬世界的關鍵平臺。從機器人、自動駕駛車隊、倉庫、工業廠房到整個城市,都能在Omniverse數字孿生中完成建立、訓練和執行。

黃仁勳說,Omniverse面向資料中心規模設計,有朝一日有望能達到全球資料規模。

愛立信正構建整個城市的數字孿生環境,幫助確定如何放置和配置每個站點以獲得最佳覆蓋範圍和網路效能,可對整個5G網路執行逼真遠端模擬。

五:AI推理:Triton推理伺服器助力實時大模型推理

目前微軟、三星、Snap等25000多家客戶都在使用NVIDIA的AI推理平臺。

今日,NVIDIA推出多節點分散式推理功能的NVIDIA Triton推理伺服器,以及NVIDIA A2 Tensor Core GPU加速器。

NVIDIA A2 GPU是一個入門級、低功耗的緊湊型加速器,適用於邊緣伺服器中的推理和邊緣AI,推理效能比CPU高出20倍。

NVIDIA AI推理平臺此次更新包括開源NVIDIA Triton推理伺服器軟體的新功能,和對NVIDIA TensorRT的更新。

最新NVIDIA Triton推理伺服器中的多GPU、多節點特性,使大型語言模型推理工作負載能夠實時在多個GPU和節點上擴充套件。

藉助Triton推理伺服器,Megatron 530B能在兩個NVIDIA DGX系統上執行,將處理時間從CPU伺服器上的1分鐘以上縮短到0.5秒,令實時部署部署大型語言模型成為可能。

在軟體最佳化上,Triton推理伺服器的模型分析器,新工具可以自動化地從數百種組合中為AI模型選擇最佳配置,以實現最優效能,同時確保應用程式所需的服務質量。

RAPIDS FIL是針對隨機森林和梯度提升決策樹模型GPU或CPU推理的新後端,為開發者使用Triton進行深度學習和傳統機器學習提供了一個統一的部署引擎。

Triton與AWS、阿里雲等平臺整合,並支援在各代GPU、x86 CPU和Arm CPU上最佳化AI推理工作負載。NVIDIA AI Enterprise也集成了Triton。

NVIDIA AI Enterprise是一款經NVIDIA最佳化、認證和支援的用於開發和部署AI的端到端軟體套件,客戶可利用它在本地資料中心和私有云的主流伺服器上執行AI工作負載。

NVIDIA旗艦TensorRT推理引擎亦進行了更新,已原生整合到TensorFlow和PyTorch中,只需1行程式碼,就能提供比框架內推理快3倍的效能。

NVIDIA TensorRT 8.2是SDK的最新版本,可實時執行數十億個引數的語言模型。

NVIDIA還宣佈微軟會議軟體Teams採用NVIDIA AI和Azure認知服務。

微軟Azure認知服務為高品質AI模型提供基於雲的API,以建立智慧應用程式。他們在用Triton執行語音轉文字模型,為微軟Teams使用者提供準確的實時字幕和轉錄。

微軟Teams每月有近2.5億活躍使用者,微軟Azure認知服務上的NVIDIA GPU和 Triton推理伺服器使用28種語言和方言,結合AI模型幫助提升實時字幕和轉錄功能的成本效益。

Mavenir宣佈由NVIDIA Metropolis AI-on-5G平臺提供支援的MAVedge-AI智慧影片分析,以加速企業人工智慧,該方案預計2022年初提供給客戶。

六、資料中心:全新網路安全功能

面向資料中心,黃仁勳宣佈推出BlueField DOCA 1.2來支援全新網路安全功能,希望使BlueField成為業界構建零信任安全平臺的理想之選。

目前有1400名開發者正在BlueField上進行開發,現在採用BlueField的網路安全公司已可提供零信任安全即服務。

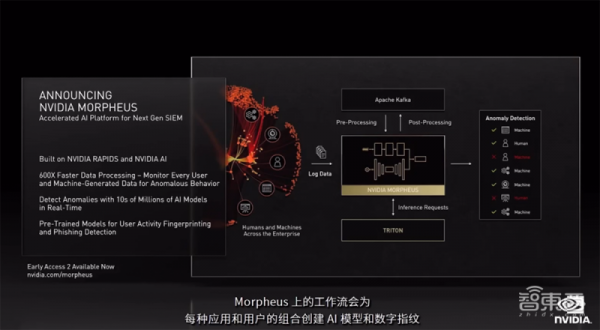

NVIDIA還發明瞭一個深度學習網路安全平臺Morpheus來監控分析網路行為。

它構建於NVIDIA RAPIDS和NVIDIA AI之上,其工作流會為每種應用和使用者的組合建立AI模型和數字指紋,並學習其日常的模式和尋找異常操作。這些異常操作將觸發安全警告,並提醒分析員作出響應。

Bluefield、DOCA和Morpheus都是資料中心的全堆疊加速AI解決方案的一部分。NVIDIA將為其網路安全合作伙伴提供一個零信任的安全平臺,從而提高安全性和應用程式效能。

Bluefield坐在網路上,向Morpheus AI平臺提供資料中心發生的所有活動。Morpheus是一個深度學習網路安全平臺,可以監控和分析來自每個使用者、機器和服務的所有資訊。

NVIDIA今日也宣佈了Morpheus早期訪問2版本。

Morpheus建立了預訓練的使用者活動指紋模型。當這些指紋發生變化時,它能夠實時識別出異常交易正在發生,建立一個可疑行為正在發生的安全警報,並隔離活動和加以提醒。

七、醫療健康:合作癌症中心,推新機器人平臺

在醫療健康領域,NVIDIA宣佈與多家先進癌症中心合作,將AI的力量帶到癌症治療。這些癌症中心將採用NVIDIA DGX來加速開發AI模型。

許多醫療裝置公司正在將AI和機器人技術融入其中,在機器人手術、移動CT掃描、支氣管鏡檢中使用NVIDIA加速計算平臺。

為加速AI醫療裝置的應用,NVIDIA推出一個面向醫療健康行業的新計算平臺NVIDIA Clara Holoscan。

Holoscan是繼Isaac和Drive後,NVIDIA的第三個機器人平臺,能為可擴充套件、軟體定義、端到端流媒體資料處理的醫療裝置提供所需的計算基礎設施。

該平臺集成了NVIDIA AGX Orin和ConnectX-7,FP32算力達5.2TFLOPS,AI算力達250TOPS,740Gbps高速IO用於連線感測器。

新增RTX A6000 Ampere GPU後,可獲得另外39TFLOPS(FP32)和超過600TOPS的AI推理效能。

Clara Holoscan是一個醫療裝置與邊緣伺服器無縫連線的端到端平臺,能助力開發者建立AI微服務,用以在裝置上執行低延遲串流應用,同時將更復雜的任務傳至資料中心資源。

藉助Clara Holoscan,開發者可以自定義應用,按需在其醫療裝置中充分新增或減少計算和輸入/輸出功能,從而平衡延遲、成本、空間、效能和頻寬的需求。

Clara Holoscan SDK透過加速庫、AI模型和超聲波、數字病理學、內窺鏡檢查等參考應用支援此項工作,以幫助開發者利用嵌入式和可擴充套件的混合雲計算。

在藥物發現方面,加拿大AI製藥創企Entos發明了一種深度學習架構OrbNet,用物理機器學習方法訓練圖神經網路,取代分子模擬中昂貴的原子間作用力,將分子模擬速度提高1000倍。

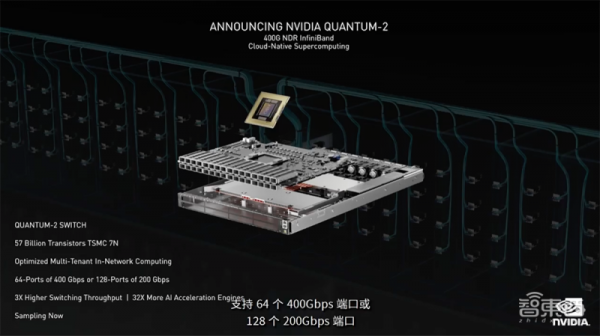

八、Quantum-2:史上最先進端到端網路平臺

此次GTC期間,NVIDIA還宣佈了下一代NVIDIA Quantum-2平臺,可進行雲原生超級計算。

該網路平臺由NVIDIA Quantum-2交換機、ConnectX-7網路介面卡、BlueField-3資料處理單元(DPU)和支援新架構的所有軟體組成。ConnectX-7將於明年1月問世。

其中,Quantum-2 InfiniBand交換機基於新的Quantum-2 ASIC,採用臺積電7N節點,包含570個電晶體,超過有540億電晶體的A100。

Quantum-2 InfiniBand擁有400Gbps,網路速度翻倍,交換機吞吐量增加了2倍,叢集可擴充套件性增為原來的6.5倍,同時降低了資料中心的功耗。

其多租戶效能隔離利用先進的基於遙測的擁塞控制系統,確保可靠的吞吐量,無論使用者激增或工作量需求激增,都能確保可靠的吞吐量,從而防止一個租戶的活動干擾其他租戶的活動。

相比上一代,第三代SHARPv3TM網路計算技術的交換機計算能力比原來高32倍,用於加速AI訓練。

九、新加速庫:最佳化路線規劃,加速量子模擬

最後,我們來看看NVIDIA推出的3個新加速庫。

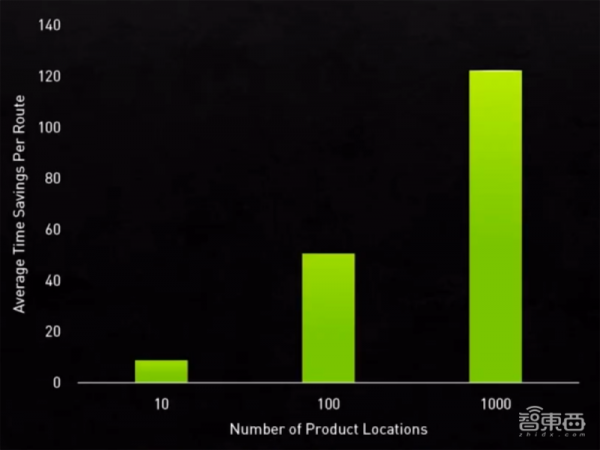

首先是NVIDIA ReOpt,這是一款針對運籌最佳化問題的加速求解器,可實現實時路線規劃最佳化。

以與NVIDIA合作的達美樂披薩為例,配送14個披薩的路徑有870億種,這意味達美樂要在30分鐘內將披薩送達絕非易事。

運籌最佳化對“最後一英里”配送是必需的,路線規劃是個極為棘手的物流問題,如果應用到行業中,即使是小規模的路線最佳化也能節省數十億美元。

黃仁勳展示了一個用NVIDIA Omniverse虛擬倉庫來展示最佳化路線在自動訂單揀選場景中的影響,最佳化後的規劃能使訂單揀選節省一半的時間和路程。

當前路線最佳化求解器收到新訂單後,需要數小時來重新執行和響應,而ReOpt能持續執行並實時動態地進行重新最佳化,在短短几秒鐘內響應並擴充套件至數千個位置。

第二個是cuQuantum DGX裝置,配備有針對量子計算工作流的加速庫,可用態向量和張量網路的方法來加速量子電路模擬。

谷歌Cirq將成第一個得到加速的量子模擬器。

藉助該裝置,曾經需要耗費幾個月的模擬,現在幾天就能完成。

NVIDIA研究部門在量子演算法模擬方面取得了重要里程碑,用1688個量子位為3375個頂點集求解MaxCut問題。

這是有史以來最大的精確量子電路模擬,比以往模擬的量子位多8倍。

cuQuantum DGX裝置將在第一季度推出。

第三個加速庫是在PyData和NumPy生態系統的大規模加速計算cuNumeric,它允許使用者用Python程式碼在超級計算機上透明加速和擴充套件NumPy工作流,並無需更改程式碼。

它屬於NVIDIA RAPIDS開源Python資料科學套件,RAPIDS今年的下載量超過50萬次,比去年增長了4倍多。NumPy在過去5年下載量達到了1.22億次,別用於GitHub上近80萬個專案。

在著名的CFD Python教學程式碼中,cuNumeric能擴充套件至1000個GPU,而擴充套件效率僅比線性擴充套件效率損失了20%。

結語

乘著AI、高效能計算和元宇宙的東風,NVIDIA今年過得可謂風生水起,市值一路扶搖直上,突破7700億美元。其Omniverse平臺更是被分析機構視作NVIDIA一項重要的平臺擴張戰略。

在這表面風光的背後,NVIDIA的遠見和前瞻性不容小覷。無論是如火如荼的AI,還是方興未艾的虛擬世界,NVIDIA能成為科技熱潮的直接受益者,都離不開過去多年對其軟硬體產品的打磨。

此次NVIDIA GTC大會期間,我們還將看到更多覆蓋深度學習、資料科學、高效能計算、機器人等領域的最新進展,而始於NVIDIA CUDA的加速計算正在這些領域催化效率提升,推動現代科技快速進化、走向未來。