鐳射雷達最主要的功能就是檢測真實的3D點雲資料,所以可能大家最關注的指標就是距離。

距離與選擇的晶片方案、晶片設計和信噪比相關,這個當然是物理上的一些事情。但實際上,真正需要考慮的因素其實是蠻多的,是很具體或者很需要去確定的一些東西。

首先是被測物體的反射率。探測距離是跟被測物體的反射率是一個強相關性的事情,就是說我們看一個反射率90%的物體(比如白牆)和看一個反射率10%的物體(比如黑牆),能測試的最遠距離上差數三倍,這個差距是非常大的。

其次,就是測距的機率。

為什麼會有機率這個事呢?按不同的方案對這個事情的解釋或者說原因還不太一樣。

比如說單光子探測是最明顯的,單光子探測具有少數光子的靈敏度,在這種情況下,是存在泊松分佈 Poisson distribution的,簡單說就是會有一定的機率看不到這個光子。

所以這是為什麼我們看單光子探測會有一個很重要的指標叫PDP,就是探測光子的機率。在940奈米的話,可能這個機率基本是在10%左右,根本上來說是物理的原因。

除了剛才說的兩點之外,鐳射雷達是一個系統級的產品,它有各種各樣的指標是互相牽連的。

這裡面比較主要包括有解析度、視場角、幀率。這些因素甚至還有其他因素互相攪在一起,所以我們在做一個距離指標的時候離不開這幾個因素。所以大家一般給指標時都是一些典型的值,但實際上這些東西是互相關聯的。

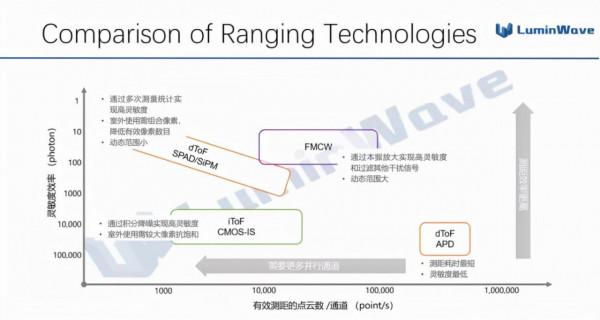

這四個顏色的方框是目前在測距方案裡面最常見的幾個流派,他們的原理差別非常大,無論是用功率還是用光子數來評價其實都不公平。

我試圖用這個圖把這四個技術放在同一個圖裡來講一下。X軸代表每個探測通道有效測距的點率,跟我剛才說的幀率有點關係,就說使用這個技術的時候,每個通道每秒鐘能測多少個點。

Y軸代表靈敏度效率,注意這不是靈敏度的概念,不是說這裡面的光子數越小代表能測的距離越遠。

大概意思是一共用多少光子才能達到需要的測試距離,光子的多少包括改變出光功率,也包括改變測量時長,這個詞在教材或是文獻裡沒有的,之所以用這個概念就是為了方便一起評價這四個方案。

x和y軸是這四個方案比較本質的因素,所以能相對比較公平的來評價一下這四個技術的特色,這裡面其實沒有絕對的好和壞。

首先,是dToF方案,就是直接飛行時間測量(右下角橘黃色方框)。

該方案用APD就是雪崩探測器來做探測。我們現在已經在車上用的鐳射雷達基本都是採用這個技術。

原理就是發射一個鐳射脈衝,然後用一個靈敏度比較高的APD來探測返回來的光,然後計算兩個脈衝的時間差。它有什麼好處呢?

它在x軸上是最靠右的,也就是說它每通道每秒鐘能測點數是最多的,因為原則上它只需要看一個脈衝返回的時間就可以了。這也是為什麼現在採用這種方案的鐳射雷達基本上只需要用3~6個通道就可以覆蓋一個每秒百萬級的點密度,這個點密度適合目前很多應用,這個是現在目前採用的主流技術。

但是你可以看到缺點呢?它這個靈敏度效率的這個軸上是最低的,也就是他需要用最大的光子數,在這個情況是指峰值光功率來實現測距距離。

那如果這個光功率超過了人眼安全的限制,那就在測試距離上有了限制,你可以看到比如用905奈米的鐳射器的dToF方案能測試的最大距離大部分是在100米到150米之間(10%反射率),這個是在人眼安全限制下比較遠的測試距離。

但如果想測的更遠,就需要把波長換到對人眼更安全的1550奈米,然後來用更大的光功率來實現更遠的距離。

其次,是iToF方案,就是間接飛行時間測量(左下角綠色方框)。

該方案其實就像我們手機裡的CMOS攝像頭一樣透過積分方式來獲取很高的靈敏度。

雖然說並沒有單光子能力,但是可以加時間,可以讓這個光子一點點進來,一點點積累,積累到一定程度能探測了,再把這個資料在輸出。

所以其實也能達到非常高的靈敏度,也可以測非常遠的距離,但是效率會比較低。

另外就是說你如果想測的距離遠,你就需要積分時間足夠長。

然後你看這個圖上這個綠色的框在x軸上很長,覆蓋很長一個範圍就是因為如果想測的遠,就要用更長的積分時間,那每秒的點就少,如果你測距離近,這樣就可以提高這個數字。

所以你可以看到,做這種iToF的方案的話基本都是用一個二維陣列的方式,就類似於我們影象感測器這個方式,因為每個通道需要花很長的時間,甚至是毫秒級來進行測量,那當然就是我們希望同時能採集更多的點,然後同時把這個資料輸出,這個是這個技術一般使用的方式。

再次,也是dToF直接飛行時間測量,但是用的是SAPD或者SiPM。

這個技術在圖中是斜著放的的一個區域,因為它可以原則上達到單光子靈敏度,但是你需要等足夠長的時間和重複測量次數。

實際上單光子探測在科學實驗上是真的可以測單光子,但實際上在我們鐳射雷達室外場景下應用的話,基本上也是百光子量級的脈衝,需要在合理的採集時間和靈敏度平衡下進行。

單光子探測是一個靈敏度非常高的技術,但有一個缺點就是說它太靈敏了,任何一個噪聲源比如說太陽光、比如說環境光、比如說電路里的噪聲電子,任何一個單個的電子或者光子都可能會造成一個假訊號,那這樣的話測量的訊號並不知道真還是假。

那你怎麼做呢?你就經過多次測量,比如測幾百次,測幾百次之後你把它作為做一個頻次圖,頻次最高的那個峰值是最有可能是真實訊號的,把這個訊號作為時間對應的距離。

所以雖然是用脈衝來測時間,但實際上我們需要發射和採集很多次,而這個很多次之間還需要停頓一段時間,有一個死亡時間,單光子探測材料和物理上的限制造成你不能立刻採集下一個脈衝,所以就變成單光子探測也需要花比較長的時間探測一個點,就有點接近於iToF的情況,一般也需要大規模2D陣列。

但為了能在室外環境光下使用,一般需要把多個畫素組合,做所謂的coincidence探測,比如4x4甚至8x8組合,這樣往往把一個SPAD陣列的有效畫素數減少的非常厲害,造成解析度指標的下降。

最後,是FMCW,調頻連續波相干探測(中間紫色方框)。

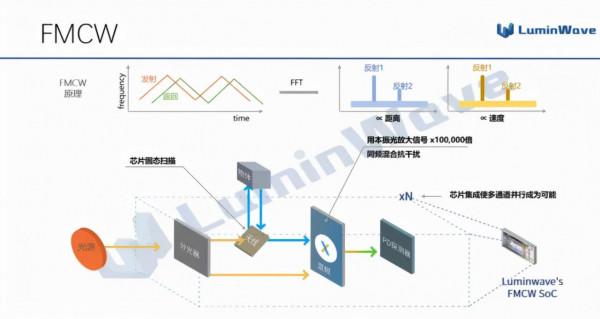

FMCW簡單來說就是透過一個本振光,就是我們把發射的光留一小部分,然後大部分是作為一個探測的光源輸出了,透過物體返回來之後,跟本振光進行相干混合,是個相干探測的一個技術。

我們的3G、4G手機訊號裡面經常做這種相干混頻的事情,在光通訊裡面也做很多相干探測的方案,物理原理和公式都是一樣的,不過這裡是一個模擬訊號。

經過這種相干探測之後,如果我們調製這個訊號的頻率可以測這個兩個訊號之間的一個頻率差,我們採集一段時間的資料,利用傅立葉變換把時域的訊號變成頻率的訊號,對應的頻率差的峰值,就能知道這個頻率變化,我們就可以推出距離資料。

這個主要有兩個好處:一個就說透過本振能有很大的放大這個訊號,只要1mW的光去放大1pW的訊號,這個放大倍數是非常高的,這個放大是相乘的關係,同時因為這個放大訊號是跟距離的1次方成反比(而其他任何方案都是和距離2次方成反比),動態範圍非常大。

另外一個好處就是透過本振混頻的這種方式可以有非常強的抗干擾性,這個我後面會說的更仔細一點。

但是,它的缺點是需要採一段時間的資料,並不說一個脈衝回來立刻可以完成測試,這個時間並不會像iToF或者像多次測量SPAD這麼長,所以FMCW在x軸上的位置是介於這些方案中間的一個位置。

但是因為它需要時間,它也需要更多的通道數才能完成需要點雲數,所以它一定是一個多通道的方案。應該說不會是dToF一樣3~6個通道的問題,但也不至於都要320*240這種2D陣列,應該是一個10~100級別的通道數方案。

對於FMCW,剛才我已經講過了從原理上看就是利用隨時間變化的頻率,然後透過反射回來的波跟本地的這個波的頻率差,透過三角波調製的計算可以得到兩個方程,可以得到跟距離成正比的傅立葉變換圖,同時可以得到跟速度成正比的傅立葉變換圖。

如果你有多個物體,還可以讀到多個峰值,你可測的多個物體,比如說有半透明的物體作為第一次反光,後面還有一個不透明的物體作為第二次反光,你可以測兩個峰值。

我們為什麼做FMCW

然後我剛才提到我們會著眼於一個比較長的時間,因為我們認為這個賽道不是一個3、5年的事情,這是一個非常長、非常寬的一個賽道,長是指應用的時間比較長,寬是指應用的方向比較多,因為我們相信這個3D感測未來會像攝像頭一樣到處都是。

那你如果把眼光放這麼長去看的話,你想的就是一個能走到最後的方案,那最後方案我們會需要什麼呢?

測試距離實際上各個方案努力一下都有可能達到一個比較遠的距離,比如使用1550nm的鐳射,做脈衝ToF也可以達到一個200米以上甚至更遠的距離。

但姑且不提1550nm脈衝光纖鐳射器的成本問題,除了成本之外我們也可以看到FMCW的一些好處。

如果你認為鐳射雷達是一個很長遠的賽道,未來會是到處都是,路上的各種車甚至設施都會有鐳射雷達,作為智慧駕駛V2X的補充,這樣的話會有很多鐳射雷達互照,那互擾會是一個比較大的問題。

當然ToF是可以用編碼的方式做一些抗干擾,但是如果做編碼就意味著在時間上做一些取樣,那又回到了剛才的問題上,本來ToF是一個單點測試時間很短的技術,你加上編碼把時間拉長了,那你是不是需要更多的通道呢?

那麼APD怎麼解決多通道的問題呢?現在是3個通道、6個通道,那怎麼解決30個通道、60個通道的問題呢?掃描的方案是不是也要跟著變?這就是一個很有挑戰的事情。

但是FMCW用的是一個很窄頻的鐳射器,這個頻率是在100kHz量級,如果你換算一下的話是在百萬分之一奈米這麼窄的一個光譜上,然後這個光譜自己鐳射器跟自己做混頻,而這個混頻的優勢就是其他跟這個頻率不吻合的頻率訊號會過濾掉。

也就是說可能發生同頻的情況在百萬分之一奈米這個範圍之內,這產生互擾的機率非常低。對於陽光也是一樣,陽光雖然是一個廣光的光,但是在百萬分之一奈米能夠進來的光非常少,FMCW是唯一一個可以對著太陽照而不飽和的鐳射雷達方案。

另外就是左邊這個圖,想說的是速度直測這個事情。

我和很多自動駕駛感知團隊有比較多的交流,他們今年拿到了國外某FMCW鐳射雷達的樣機,然後在測試過程中發現速度場真的是很好的一個東西,在很多corner case能夠提供很好的判斷依據。

我們看左邊這個圖,車和人如果距離比較近,用3D深度圖是很難做語義分割,但是如果看速度場,車和人的速度相差非常大,可以直接把兩個物體分割出來,佔用很小的資料量的資料維度就可以獲得非常巨大的好處。

另外一個晶片可以實現的事情就是純固態掃描。

無論成本上來說還是可靠性來說,大家都希望最後的方案一定是一個純固態的方案。

無論是早期的360°機械旋轉的方案,還是目前已經上車的半固態方案,大家都認為是一個過渡的方案。過渡的時間可長可短,最終一定要實現一個純固態的方案。純固態方案用晶片來實現是一個必然的一個事情。

晶片的純固態掃描大體有下面三種方式:第一種就是OPA就是相控陣的方式,相控陣其實在無線電通訊裡面使用很多年來了,就是靠天線陣列之間互相干涉進行遠場的光斑掃描。

第二種就是Focal Plane Array,基本上就是把畫素反過來用,是一個不同角度的光作為發光源,發射出去形成不同角度的發射和照射。

第三種就是一個用波長來進行掃描,這個在學術界比較常用,有一些做產品的人也考慮用這個,這個就是用波長和晶片的Dispersion色散的功能,不同的波長透過晶片到達不同的方向,這個和稜鏡的道理差不多,分光的一個道理,然後實現不同角度的掃描。

這些方案各有利弊,沒有一個方案是有完全的優勢的,這就涉及到系統引數的選擇和應用場景的配合。

簡單來說對於OPA來說掃描的角分辨和靈活性非常強,隨時可以掃描任何角度,任何順序,任何的點,可以達到很高的角解析度,只要陣列做的足夠大,但是它的缺點就是有旁瓣的干擾,這個地方需要做特殊的處理。

剛才說的雖然可以達到很高的解析度,但是達到很高的解析度需要做一些犧牲,你的晶片天線數會增多,晶片會變得更復雜,功耗會提高,控制會更復雜。

對於Focal Plane Array,實現起來比較簡單,就是不同通道而已,但是它的損耗較大,因為要進行分光,每個光就會變小,同時點亮很多畫素的話就會有問題,角度是固定的,這個設計好角度就不能隨時調了。

第三個波長掃描這個事情,控制會比較簡單,波長一改變方向就跟著改變,感覺概念很簡單,但是Dispersion色散不是一個很強的效應,需要一個很寬的光譜的範圍才可以調一個比較大的角度範圍,而很寬譜可調的鐳射器的難度和成本是比較高的,這是一個比較主要的限制。

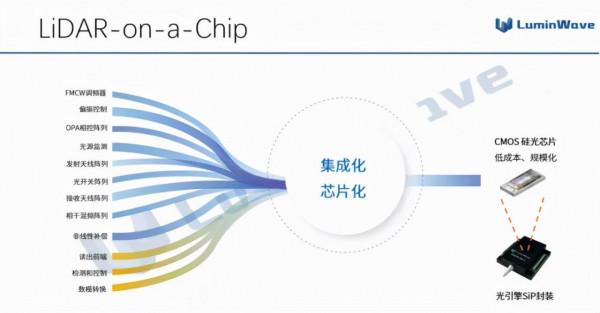

最後就簡單說一下洛微科技做的事情。

我們做一個大規模整合的基於CMOS矽光的晶片。裡面我們集成了多組通道的FMCW,也集成了很多其他的功能,包括天線、相控陣以及各種各樣光學上的功能。

這是一個整合光學的SoC系統級晶片。我們把光晶片和電晶片封裝在一個晶片裡面,我們叫光引擎,是一個SiP的封裝。

實現完整的固態掃描和FMCW探測,形成我們產品的一部分,最終加上其他部分會變成一個完整的鐳射雷達產品。