電子發燒友網報道(文/梁浩斌)在自動駕駛的感測器選擇上,目前在量產車型上主要有幾種選擇,一是視覺+毫米波雷達(當然現在特斯拉要走的是純視覺路線),這也是目前大部分L2級輔助駕駛車型上所採用的感測器方案;二是鐳射雷達為主,加上視覺感測器以及毫米波雷達,以多感測器融合的方式實現更高階的自動駕駛。

要實現高階自動駕駛,需要獲取更多的路面資料,而為了獲取路面資訊,目前主流的鐳射雷達、影象感測器、毫米波雷達是否就能夠滿足需求呢?

舉例來說,2018年Uber採用鐳射雷達+毫米波雷達+視覺感測方案的自動駕駛汽車,在夜間進行測試工作時安全員分神,而車輛撞到一名行人並導致其死亡。在這起事故中,自動駕駛車輛在發生撞擊前5.6秒其實就已經檢測到了行人,但將其錯誤識別成汽車,而在5.6秒時又將識別到的行人歸類為其他物體,導致系統無法判斷該物體的性質而未有進行剎車動作。

而特斯拉的視覺+毫米波雷達同樣出現過多次事故,比如車輛在高速公路上行駛時,無法識別因事故而橫倒在路上的白色貨車而發生碰撞事故。

這裡表現了當前自動駕駛感測器組合中的一些欠缺,無論是以鐳射雷達為主的路線,還是純視覺的路線。可以發現,目前紅外感測器在自動駕駛的主流方案上比較罕見。

當然,為了更高的安全性,自動駕駛需要更大的冗餘空間,比如用不同的感測器來針對不同的場景進行識別。自動駕駛有兩大核心,感知和演算法,要演算法體現出實際效果,第一步是要“看得見”。

紅外熱成像相比於其他感測器,首先在識別生物上具有無可比擬的優勢。前面提到的Uber夜間行駛事故,雖然有一部分是由於多感測器導致的系統錯誤,無法判斷物體,但如果加上紅外熱成像技術,增加從溫度去判斷物體的性質,就可以從根源上解決物體判斷的難題,特別是在行人識別方面。

其次,不只是在夜間,紅外熱成像是可以全天候工作的,不受白天夜間影響,並且可以彌補視覺感測中難以防止眩光的劣勢。

另外,紅外在霧霾等惡劣天氣環境中有良好的穿透效果,這也是鐳射雷達以及視覺感測的劣勢場景之一。

既然效果這麼好?那麼為什麼很少聽到有自動駕駛車型用上紅外熱成像技術?

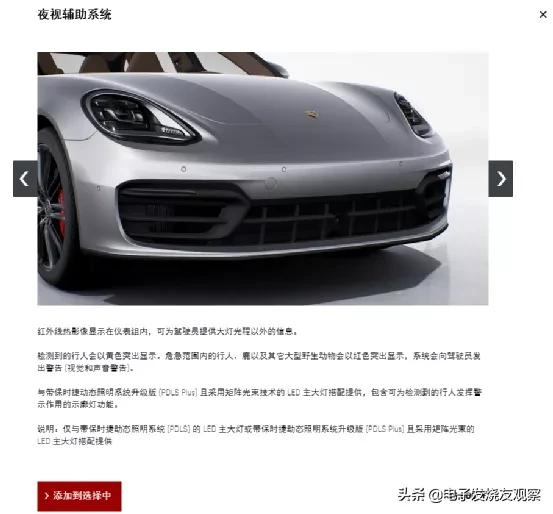

事實上,我們在新款的保時捷帕拉梅拉車型上發現,紅外熱成像已經成為一項選配,保時捷稱之為“夜視輔助系統”。只是其主要功能不是用於自動駕駛,而是用於在檢測應急範圍內的行人或者野生動物,並向駕駛員及時發出警告。

其實,上述問題的答案很簡單,那就是貴!保時捷選配價格高達39500就能說明這一點。與幾年前的鐳射雷達一樣,由於規模效應還沒有體現,目前紅外熱成像感測器價格居高不下。

筆者在與國內某紅外成像技術大廠交流時瞭解到,目前其車載紅外產品最高可以實現1920×1080解析度,但僅640×512解析度的中遠距離車載紅外熱成像產品單價也要萬元以上。

隨著自動駕駛技術的發展,紅外熱成像是否會被更多的主機廠加入到自動駕駛感測器“全家桶”中?我們將持續關注。