近日,仿生事件感測器領域有兩個突破性進展。一是索尼半導體釋出兩款堆疊式事件監測視覺感測器(EVS, Event-based Vision Sensor),利用 Cu-Cu 連線的 3D 堆疊工藝,將事件驅動相機的畫素尺寸從 15um 大幅減少到 4.86um。

另一個突破性進展是華為利用普通攝像頭結合仿生事件相機來捕抓高畫質的慢動作影片,此一研究成果成功入選 CVPR 2021。兩大進展象徵隨著巨頭加速入局神經視覺感測器領域,該技術距離成熟商用化落地更進一步。

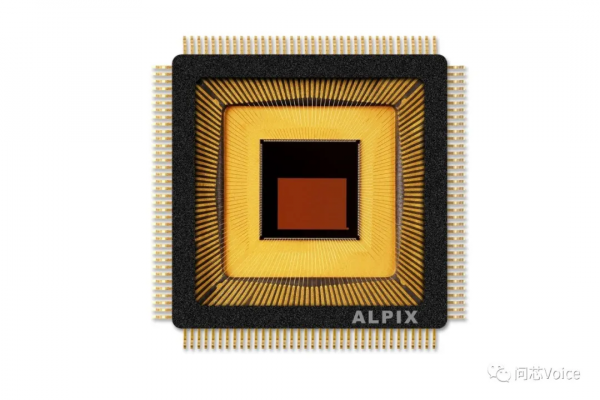

在國內,神經擬態相機或仿生事件相機是屬於技術非常創新的領域。專注於新一代計算機視覺感測領域的晶片業者北京銳思智芯,於近日釋出全球首款仿生事件相機技術與 CIS 技術融合的相機 ALPIX-Pilatus。

銳思智芯提出獨創 “ Hybrid Vision” 技術,以融合仿生事件視覺感測器及高階影象感測器,讓該公司的核心產品—融合式仿生事件視覺感測器晶片 ALPIX 既可輸出事件流訊號,也相容輸出高質量的影象訊號。

這種二合一的功能,可有效降低視覺系統方案的成本,客戶更容易開發相關演算法及應用,並有效提高晶片信噪比,改善噪聲問題及暗光效能。

此優勢也正好解決當前市面上的仿生事件視覺感測器晶片的最大問題。因為沿用了最早期學術研究中採用的技術路線,導致有很多不足之處,比如信噪比低、噪聲高、與 CIS 不能很好相容。

銳思智芯成立於 2019 年 7 月,是一家專注於新一代計算機視覺感測領域的晶片研發及整體方案提供商,研發團體主要來自於浙江大學、劍橋、瑞士蘇黎世聯邦高等理工學院等世界名校,團隊成員曾就職於 CSEM、英特爾、NXP、Arm、安森美、Magic Leap 等國際著名公司。

很多人會問,神經形態視覺感測器的技術原理存在數十年,為何在此時會吸引國際大廠爭相入局?

自 2015 年人工智慧技術與商用落地在各類應用中實現,視覺相關的領域逐漸由人看轉變為機器“看”。

相較於傳統 CMOS 影象感測器晶片 CIS,仿生事件視覺感測器晶片更適合用於計算機視覺、人工智慧領域,也被稱為事件驅動相機 (Event-based Camera)。

傳統 CIS 由於快門統一控制曝光的工作原理,導致用於計算機視覺領域時,就暴露了一系列缺陷,比如速度慢導致運動模糊、資料量大造成頻寬佔用高及功耗高、易受環境光影響等。

仿生事件視覺感測器晶片是模仿人眼的視網膜神經,讓每個畫素獨立工作,透過感知外界光強變化來輸出變化的脈衝訊號或事件流訊號,也就是以事件驅動的原理,來捕捉一個場景中的關鍵資訊,大量降低資料冗餘和延遲。

進一步解釋畫素工作方式的區別:

CIS 是基於電荷,需要對電荷進行積分之後,才能有輸出。也就是說,在電荷積分的這個過程,CIS 畫素不區分在這個過程中的變化,這也就限制它的取樣頻率,無法捕捉高速運動物體。而且運動的疊加,就可以理解成多個虛擬幀的圖片重合在一起,使得影象模糊。

EVS 是基於 PD 電流,監測PD的電流訊號是否發生了變化。變換超過一個給定的閾值,以 2bit 訊號輸出;即變強 01 或變弱 10,若變化不超過閾值,則為 00;所以可以響應高頻訊號,即快速變化的物體。同時其計算過程是所有畫素同時進行數模轉換,這是一個並行過程。而且因為轉換簡單,這個 2bit 的數模轉換非常迅速,從而實現了非常高速的整個畫素陣列的轉換與輸出,達到高幀率。

EVS 與CIS 相比,具有速度快 (>1000 幀/s)、功耗低、冗餘資料量少、動態範圍大 (>120dB) 等特點,可解決計算機視覺當前面臨的一些痛點。

進一步的解釋原理,傳統 CIS 是以“幀”為單位來記錄動態影像畫面,但如果畫面一直處於靜止狀態,不斷紀錄的結果是每一幀都是重複地,導致大量冗餘的資訊,造成儲存和計算的負擔。

如果加入事件訊號,就可以在場景出現變化時,畫素才做出反應,而場景沒有變化就不會有資訊輸出。這樣就不會因為在靜止畫面時,仍是逐幀重複紀錄大量無意義的資訊,導致大量無用資料。

華為在 CVPR 2021 展示的慢動作影片,每秒 53 幀影片變成 960 幀的研究成果,也是採用同樣原理,由一個一般相機來記錄低幀的實際畫面,再用一個事件相機來記錄畫素亮度變化。

除索尼、華為以外,三星算是最早一批將事件相機技術匯入商用化的國際大廠,在 2015 年左右加入戰局。

2016 年,三星將事件相機匯入自動駕駛平臺上,除了極低功耗的表現,其鏡頭以 2,000 fps 更新率追蹤物體,對比一般數碼相機為 120fps。 2019 年,三星便開始在手機與平板電腦應用的動態視覺感測器 DVS 技術領域申請商標。

正是因為事件相機的特性,各大廠看中其市場潛力,紛紛入局。根據 Yole Development 報告顯示,2020 年全球 CIS(CMOS 影象感測器)的市場價值達到了 207 億美元,預計到 2026 年,全球 CIS 市場總量預計將達到 315 億美元。再者,有報告顯示,2029 年神經擬態半導體感測和計算晶片將可達到約 70 億的市場規模。

談完仿生事件視覺感測器的原理特性,那銳思智芯的技術與市面上的同業相較,具有哪些獨特的優勢?

銳思智芯 CTO 查穎雲指出,公司的技術最早源於 2014 年瑞士國家級基金扶植的生物醫學專案,是一種仿視網膜晶片技術,用來植入眼球,代替成為盲人的視網膜。後來該專案成功商用化後,賣給一家以色列公司,成功將仿視網膜晶片運用在機器視覺平臺上。而銳思智芯的兩位創始人鄧堅和查穎雲都是該專案的技術骨幹。

查穎雲進一步指出,市面上的仿生事件視覺感測器晶片不少,但多是沿用 20 多年前學術研究的技術路線,現在來看實現方法都過於老舊,沒有把新的 CMOS 技術運用進去。因此,在應用落地過程中,存在一系列難點。

首先,純粹的事件相機難以滿足實際應用的需要。

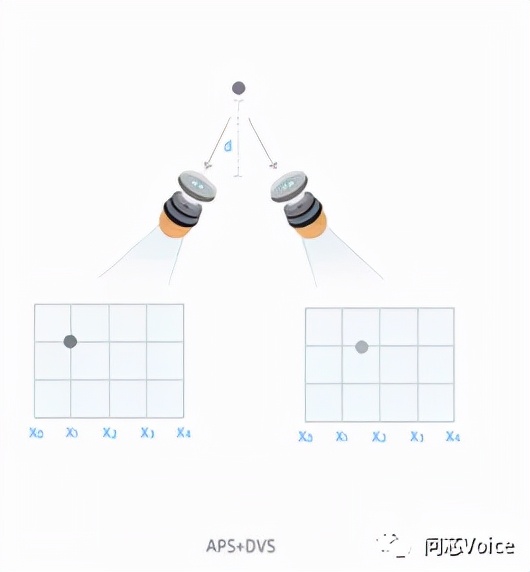

在大部分實際應用場景中,需要事件流訊號來做快速預判,也需要影象訊號做複雜重建(比如稠密 3D 重建)和精細判斷(比如人臉識別)。用 EVS 晶片需要配合 CIS 使用,比如至少需要一個 EVS+一個 CIS 組成雙攝系統。但此方案由於資料結構不同,在演算法上模態是不一樣的,很難進行空間位置上的配準和對齊,融合演算法開發難度大,所以很難真正實現應用落地。

相較之下,ALPIX 融合方案能夠同時輸出 EVS 和 CIS (APS)訊號。因此具有 EVS 的優點,同時還能夠輸出 CIS 的影象訊號;即一顆攝像頭可替代兩顆攝像頭的功能。此外,相比於 EVS+APS 雙攝方案,ALPIX 融合方案,在空間位置上是已經對齊的,因此解決了雙攝異源影象對齊的問題。

Figure 3:ALPIX 晶片中事件流訊號與影象訊號共用同一個畫素

當然, 當前行業中也有一類事件相機可輸出事件流訊號及光強灰階資料,但因其畫素的設計等原因,基於該光強灰階資料生成的影象在信噪比、暗光表現、固定模式噪聲(Fixed Pattern Noise)、溫度穩定等方面與傳統CIS的輸出的影象還存在較大改善的空間。

再者,CMOS 技術進入堆疊式工藝 BSI 時代。透過使用堆疊式技術以及獨特的晶片設計,銳思智芯的 ALPIX 大幅縮小畫素及晶片尺寸,並且減少 CIS 電路及事件相機電路串擾以提高輸出訊號質量。使得事件相機才真正有可能應用到大部分對尺寸及訊號質量要求較高的消費電子領域。

CMOS 堆疊工藝是透過將光電二極體“放置”在了影像感測器晶片的最上層,把 A/D 轉換器及放大電路等挪到了影像感測器晶片的“背面”,來最大限度地接收光照,使得在小尺寸的影像感測器也能獲得優良的高感光度能力。

索尼最新發布的 EVS 就是基於 CMOS 堆疊工藝生產,將事件相機的畫素尺寸從 15um 減少到 4.86um。而銳思智芯的 ALPIX 晶片基於堆疊工藝同時,對晶片架構做了變革,畫素尺寸將進一步下降到現有機器視覺 CIS 的畫素尺寸。

另外,現有的仿生事件視覺感測器仍是有許多待改善之處,比如信噪比低、噪聲高、暗光條件下表現較不理想,與成熟的計算機視覺演算法不能很好相容等。

因此,銳思智芯提出經過大幅改良,且具有特殊設計和專利的 ALPIX 感測器和 Hybrid Vision 技術,與傳統 EVS 技術具區別性,來解決上述當前事件相機存在的問題。

“Hybrid Vision” 技術透過融合仿生事件視覺感測器晶片 ALPIX 和高階影象感測器CIS 晶片,讓 ALPIX 晶片既可輸出事件流訊號,也相容輸出高質量的影象訊號。

基於 “Hybrid Vision” 技術,ALPIX 更適合用於實際應用場景,特別是既需要事件流快速判斷,又需要影象資料進行詳細分析的場景,例如智慧家居、手機、物聯網、安防、機器人等。

釋出 ALPIX-Pilatus 晶片,預計將先落地於 VIoT 領域

目前銳思智芯已規劃兩個系列晶片產品:ALPIX-Titlis 融合式低功耗仿生事件視覺感測器、ALPIX-Eige 融合式高階仿生事件視覺感測器。

ALPIX-Titlis 主要用於 VIoT 領域,預計量產晶片將於明年率先落地。而應用於高階成像領域(如手機、安防)的 ALPIX-Eige 晶片也即將釋出。

ALPIX-Titlis 融合式低功耗仿生事件視覺感測器,畫素端過濾 80% 無效資訊,可節省系統成本;在適配現有影象系統基礎上,增加獨立的事件流資料,幫助提高演算法的效率及精度。適用於各類視覺 IoT 場景,比如低功耗監控相機,機器人等。

而在機器人及自動駕駛場景中,由於 ALPIX 具備精細二維 RGB 資訊,以及高速的資訊,因此非常契合這類場景的應用。機器人或自動駕駛汽車,在視覺上需要 3 個資訊;詳細的平面資訊,高速及全天候的預判資訊,精確距離資訊。ALPIX 可以提供前兩類資訊。基於 ALPIX 的快速、輕量的事件流訊號做快速的預判,如避障、緊急剎車等功能;也可以基於資訊豐富的影象訊號做高精度的視覺地圖重建及人物識別等。

此外,由於事件流訊號的高動態範圍,可以適應更復雜的光照條件,也進一步增強了機器人的感測器系統的安全性或適應性。

“不久的將來,我們甚至也可以在 ALPIX 的 Hybrid Vision 基礎上將精確的距離資訊也融合到我們的 sensor 上”,鄧堅表示。

最後,查穎雲談到視覺感測器行業即將走到一個全新的格局。隨著機器感知技術及應用的不斷髮展,以及類似於 EVS 這種新型視覺感測器技術的不斷產生,由索尼、三星壟斷的傳統 CIS 市場格局也會發生改變。國內將會有更多新興的公司產生並發展,參與到視覺感測器領域,給行業提供更多的選擇和機會。