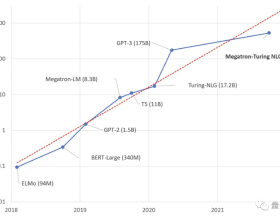

源1.0模型引數規模為2457億,訓練採用的中文資料集達5000GB,相比GPT3模型1750億引數量和570GB訓練資料集,源1.0引數規模領先40%,訓練資料集規模領先近10倍。如此大規模的人工智慧巨量模型誕生,意味著什麼?

浪潮研究院介紹,“源1.0”在語言智慧方面表現優異,獲得中文語言理解評測基準CLUE榜單的零樣本學習和小樣本學習兩類總榜冠軍。在零樣本學習榜單中,“源1.0”超越業界最佳成績18.3%,在文獻分類、新聞分類,商品分類、原生中文推理、成語閱讀理解填空、名詞代詞關係6項任務中獲得冠軍;在小樣本學習的文獻分類、商品分類、文獻摘要識別、名詞代詞關係等4項任務獲得冠軍。在成語閱讀理解填空專案中,源1.0的表現已超越人類得分。

在對“源1.0”進行的“圖靈測試”中,將源1.0模型生成的對話、小說續寫、新聞、詩歌、對聯與由人類創作的同類作品進行混合並由人群進行分辨,測試結果表明,人群能夠準確分辨人與“源1.0”作品差別的成功率已低於50%。

浪潮人工智慧研究院首席研究員吳韶華表示,一方面,巨量模型可以推動產業界做一些殺手級應用,另一方面,對於前沿技術的探索也有重要意義。“人們一直在追求一種更通用、更好的模型,能夠用於各種各樣的場景,來解決各類問題,實現真正的通用智慧。”

全球範圍內,巨量模型的發展也備受關注。斯坦福大學李飛飛教授等人工智慧領域知名學者近期在論文中表示,這類巨量模型的意義在於突現和均質。突現意味著透過巨大模型的隱含的知識和推納可帶來讓人振奮的科學創新靈感出現;均質表示巨量模型可以為諸多應用任務泛化支援提供統一強大的演算法支撐。

浪潮資訊副總裁劉軍將巨量模型比喻為“珠穆朗瑪峰”,能夠實現“見所未見”,對於科學發現和產業實踐都有巨大價值。他認為,生命從簡單進化到複雜,這種智慧水平本身就是一種模型,如果把模型比作元宇宙中的生命,大模型的這種綜合系統能力可能會決定未來數字世界和智慧世界裡的智慧水平。

“2457億這個引數夠不夠多呢?實際上還不夠多,人的神經元的突觸超過100萬億,所以,我們距離這個水平還有很遠的路要走。”在劉軍看來,未來,人類需要更大的模型、更大的資料、更大的算力,這樣才可以擁有更大的智慧。

源1.0中文巨量模型的釋出,使得中國學術界和產業界可以使用一種通用巨量語言模型的方式,大幅降低針對不同應用場景的語言模型適配難度;同時提升在小樣本學習和零樣本學習場景的模型泛化應用能力。浪潮人工智慧研究院表示,“源1.0”將面向學術研究單位和產業實踐使用者進行開源、開放、共享,降低巨量模型研究和應用的門檻,有效推進AI產業化和產業AI化的進步,切實為國家在人工智慧研究創新和產業發展作出貢獻。(戰釗)

來源: 光明網