人工智慧常常被認為是一項將要顛覆世界的技術,從這一概念誕生至今的65年中,無數電影與小說塑造了各種經典的人工智慧角色,AI (Artificial Intelligence)也很快成為人類未來世界藍圖中的重要組成部分。但在人工智慧不斷拓寬我們對未來想象的同時,也不乏“AI 統治世界”、“AI 監視隱私”等等一類的消極論調。

在所有擊碎人類宇宙中心信念基石的科學革命中,人工智慧絕對算是其中我們又愛又恨的一場。李世石被 AlphaGo 擊敗後流下的淚水已經幹了,但人類對於AI的恐懼和想象還在無限蔓延。那麼,AI真的比我們更聰明嗎?

在AlphaGo戰勝了韓國棋手李世石後,一名比利時程式設計師在 DeepMind發表的最新論文的基礎上開展了一項開源的圍棋 AI專案—— LeelaZero,曾有人嘗試與其對弈,結果是 Leela 在19路盤面取得壓倒性勝利,而在25路棋局上完敗,且無一例外。這說明只接受過19路圍棋訓練的人工智慧 Leela也只會下19路的圍棋,即使那些資料一直儲存在其資料庫中,它也不知道該如何將19路盤面的訓練“經驗”移植到 25 路圍棋的對戰上。

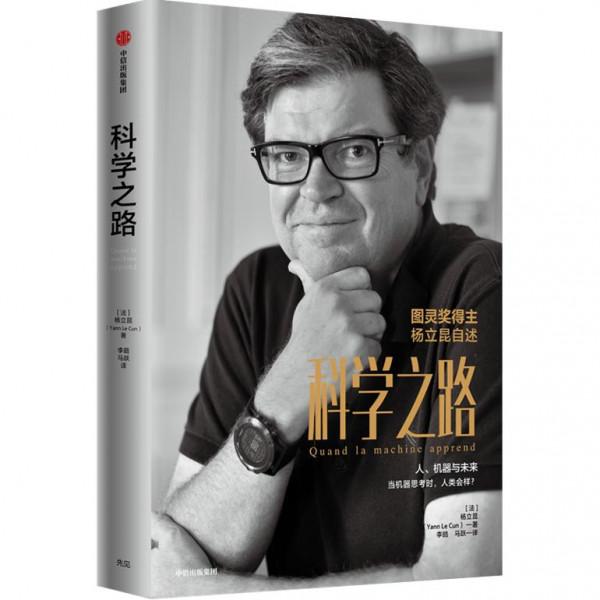

那麼問題來了,一直以來被認為終將反超人類的人工智慧,難道並不聰明嗎?圖靈獎得主、Facebook 首席人工智慧科學家楊立昆(Yann LeCun)在他的新書《科學之路:人,機器與未來》中告訴我們:AI,真的不是你想的那樣。

《科學之路:人,機器與未來》 2021.08 中信出版集團

AI,真的不是你想的那樣

人工智慧正在改變人類對自身的看法,不斷衝擊著人類獨有的的“物種”傲慢。在文藝作品中,AI 危險又美麗,為人類服務卻各方面都比人類更加強大、更有創意。但在現實中,AI 落地的應用卻往往不懂常識、行動遲緩且耗能極大。

當你凝視人工智慧時,人工智慧並不一定在凝視你,因為它根本不知道你為什麼要凝視他(至少現在不知道)。原因就是人工智慧缺乏常識,沒有感知,甚至沒有辦法根據場景變換對已儲存的知識活學活用。

DeepMind訓練了一個可以玩經典雅達利(Atari)影片遊戲的系統,系統一共包括80個遊戲,每場比賽它至少要花費80個小時來訓練,才能勉強達到合格水平,而一個人只需要15分鐘就可以做到這一點。但實際上,這80個小時是機器實時玩遊戲時所花費的訓練時間,在訓練結束之後,它可以用(比人類)更快的速度進行遊戲,甚至可以同時進行多個遊戲。也就是說,如果讓系統執行更長的時間,它將達到人類無法企及的超高效率。

但並不是所有應用AI的系統都有足夠的時間成本去用更長時間接受更多的訓練,比如自動駕駛領域。自動駕駛系統中的 AI 必須跟隨汽車在道路上行駛以獲得更多訓練資料—— 必須駕駛數百萬個小時,模擬引起成千上萬次的撞車事故,而後才能學會如何避免撞車。如果汽車掉下懸崖,系統一定會說“哦,我一定是錯了”,但這隻會稍微糾正其策略。第二次,汽車可能會以不同的方式掉下懸崖,然後系統會再次糾正一點。依此類推,在系統徹底弄清楚如何避免跌落懸崖之前,汽車必須像這樣重複跌落懸崖數千次(還不止),其執行難度和資金耗費可想而知。

以上兩個示例足夠說明一點:AI不是天才,不能輕而易舉地獲得“智慧”,它需要大量的訓練和資料支撐才能在某一具體事件上做到人們所說的“聰明”,但這中間耗費的時間、算力等等成本又遠遠超過人們的普遍預想。

人工智慧悖論:至關重要的常識

如今的人工智慧有一個悖論:它功能極其強大、極其專業化,卻沒有一點常識。

現在讓我們回過頭來看前文提到的圍棋 AI —— LeelaZero。Leela如果想要在 25 路盤面上立於不敗之地,則需要更多專門針對 25 路圍棋對戰的資料以及更長時間的自我對局訓練,才最終有可能獲得全勝局面。但 Leela 不知道圍棋的基本常識通用於不同盤面,也不懂得類推和移情。這也從另一個側面反映出了 AI 的另一個“不聰明”之處——對於人類常識的缺失。

常識缺失的人工智慧是什麼樣的呢?喚醒你的 Siri、Alexa、天貓精靈或者小愛同學,嘗試著和它對話(最多) 兩分鐘,你就多多少少有些感觸了。楊立昆在《科學之路:人,機器與未來》中也對此有過具體的描述:

一個翻譯系統有時可能會產生一些滑稽的錯誤而不自知,自動駕駛汽車可以從點A行駛到點B,但它並不知道什麼是駕駛員。比如虛擬助手可以報告交通訊息,能調到你點播的廣播電臺,但如果你告訴它,“Alexa,我的手機掉進了浴缸。”它不會知道這代表著你的手機溼了,且需要更換,因為它只能在接受訓練的範圍內工作。如果想要系統更有效地回答問題,Alexa 必須具備一些常識,即一些有關世界運作方式及其物理規律的約束知識。

常識至關重要,它制約著我們與世界的聯絡,它能填補空白,彌補隱含的資訊。我們看到一個坐在桌子旁的人,可能看不到他的腿,但知道他肯定有腿,因為我們對人類有一定的瞭解。我們的大腦還整合了物理學的基本定律,比如,如果有人打翻了眼前的玻璃杯,那麼杯子裡的水就會灑得滿桌子都是。我們知道如果不拿住某個東西,它就會掉下去。我們還能夠意識到時間流逝、萬物運動。

我們在生命的頭幾個月和幾年中逐漸瞭解世界的模型——我有意使用了與人工智慧領域相同的詞彙,這使我們可以將某個普通的句子補充完整。這個句子的其餘部分並沒有向我們提供有關整個句子的所有資訊,但我們還是能夠將這個句子補充完整,因為我們知道世界的執行規律。同樣,當我們閱讀一個文字時,可以或多或少預測到下一個句子;當我們觀看一個影片時,能夠或多或少預測到接下來一連串的動作和反應。

由此可見,人類常識對於培養人工智慧的學習能力至關重要,否則它只是一個功能強大、專業化高,卻沒有任何概念、文化、什麼都不懂且耗能極高的應用程式。

人類大腦——永遠的神

到目前為止,人類的學習方法比任何一種人工智慧的學習方法都更為有效。在人腦中,額葉專用於獲取有關世界運轉規律的常識,這就是智力的本質。動物學習的方法與人類學習的方法大致相同。有些物種的天賦更高,在鳥類中,烏鴉就特別有天賦。在海洋動物中,章魚非常聰明。再說說貓,它們沒有人類的推理能力,但依然比最聰明的機器擁有更多的常識,老鼠也一樣。所有這些動物都透過觀察來學習世界運轉的規律,獲得了可以增加生存機率的預測模型。如果人類能製造出像老鼠或松鼠一樣聰明的機器,人工智慧事業或許就成功了。

也就是說,即便是最先進的人工智慧系統也存在侷限性,它們可能還不如一隻貓聰明。此外,人工智慧不僅在智識上比不上人類大腦,在功耗的節省上也遠遠落後於人類大腦。

雖然現代科學已經瞭解了大腦學習的原理,知道了大腦的結構,但重現其功能所需的計算量是無比巨大的,大約是每秒 1.5×1018 量級的操作。現在一塊 GPU (影象處理器)每秒可執行 1013 次計算,功耗約為 250 瓦。為了達到人腦的計算能力,必須將 10 萬個這樣的處理器連線上功耗至少 25 兆瓦 的巨型計算機才能實現。這巨大的能量消耗是人腦的 100 萬倍!

所以,AI比你更聰明嗎?

最後,你要是問 AI 聰明嗎?在某種程度、某個範圍、某個具體的事件上,在掌握了大量資料和長時間的訓練之後,它可以做到更快速的反應、進行更深入的分析並處理更多的並行任務,這時你可以說,AI是聰明的。但在普遍意義的學習能力上,在我們所生活的這個複雜的世界模型裡,它還沒能積累起足夠的世界知識以產生某些常識,你也可以說,AI 是不怎麼聰明的。

也許你要提起那些模擬機器人來反駁我了,比如“索菲亞”。索菲亞是一位面帶神秘微笑、長著一雙玻璃眼珠的美麗的光頭女人,“她”在2017 年的許多舞臺上都大放異彩。“她”動人的臉龐能夠呈現數十種不同的表情,在調侃一個記者關於地球上有太多機器人的擔憂時,“她”笑道:“您好萊塢電影看太多了 !”這個經典笑話讓她如此酷似人類,以至沙烏地阿拉伯在當年授予了“她”沙特國籍。實際上,“她”只是一個由工程師預先設定好一系列標準答案的“木偶”。當我們與“她”交流時,所有的談話內容均會經過匹配系統處理,並從得到的答案中選擇最合適的一個輸出。索菲亞欺騙了人們,“她” 只是一個完成度很高的塑膠製品,只不過是我們(被這個激活了的物體所感動的人類)賦予了它某些智慧。

於是,讓AI變聰明也就成為了科學家們研究的首要任務。楊立昆在新書《科學之路:人,機器與未來》也闡述了人工智慧研究的真正挑戰:

“這些人工智慧應用將會改變社會,但是,直到機器能夠像動物和人類一樣有效地學習,直到它們能夠透過自我監督學習獲得世界模型,直到它們積累起足夠的世界知識以產生某些常識,這一切才會成為可能。”

本文摘編自中信出版集團8月新書《科學之路:人,機器與未來》。

《科學之路:人,機器與未來》內容簡介:

“圖靈獎”得主、“深度學習三巨頭”之一、“卷積神經網路之父”……由於在人工智慧領域的突出貢獻,楊立昆被中國計算機科學界和企業界所熟知。楊立昆的科學之路,譜寫了一段關於勇氣的宣言。他為了知識本身求學,而不是文憑,他用自己的經歷,證明了透過激烈的考試競爭進入名校不是科學成功的唯一路徑。他廣泛閱讀,為他科學思維的形成奠定了堅實的理論基礎。他特立獨行,做自己感興趣的事情,即便那件事在短時間裡不被人看好。在人工神經網路研究的低谷期,他寂寞地堅持,終於取得了舉世矚目的成就。人工智慧正在顛覆人類社會,未來機器能思考嗎?楊立昆的這部著作,講述正是人工智慧在我們面前崛起——這個歷史上絕無僅有的時刻發生的故事。

編輯/王雅靜