本文內容來源於《測繪學報》2021年第10期(審圖號GS(2021)6119號)

SAR影像和光學影像梯度方向加權的快速匹配方法

樊仲藜1

1. 中國測繪科學研究院, 北京 100039;

2. 蘭州交通大學測繪與地理資訊學院, 甘肅 蘭州 730070;

3. 西南交通大學地球科學與環境工程學院, 四川 成都 611756

基金專案:國家重點研發計劃(2019YFB1405600)

摘要:針對SAR影像與光學影像之間存在顯著的非線性灰度差異導致影像匹配困難的問題,本文提出了一種基於影像結構特性的快速匹配方法(SAR-to-optical fast matching algorithm,SOFM)。傳統基於影像灰度的匹配方法一般難以抵抗影像間的非線性灰度差異,而影像中的幾何結構和形狀特徵在不同型別的影像之間較為穩定,因此本文綜合利用影像的梯度幅值和梯度方向資訊構建出一種能夠有效表達影像結構的特徵描述符—角度加權方向梯度(angular weighted orientated gradients,AWOG),隨後基於模板匹配的策略,選擇描述符之間的差值的平方和(sum of squared difference,SSD)建立用於匹配的相似性測度,並給出了在頻率域中表達的影像匹配函式。基於SOFM方法建立了一套完整的影像匹配流程,隨後選擇多組影像進行匹配試驗,結果表明,本文方法能夠有效抵抗SAR影像與光學影像之間的非線性灰度差異,並且在匹配效能和匹配精度等方面都優於經典的基於影像灰度的匹配方法以及其他基於影像結構特性的匹配方法。

關鍵詞:SAR影像 光學影像 結構特性 影像梯度 模板匹配

引文格式:樊仲藜, 張力, 王慶棟, 等. SAR影像和光學影像梯度方向加權的快速匹配方法[J]. 測繪學報,2021,50(10):1390-1403. DOI: 10.11947/j.AGCS.2021.20200587

FAN Zhongli, ZHANG Li, WANG Qingdong, et al. A fast matching method of SAR and optical images using angular weighted orientated gradients[J]. Acta Geodaetica et Cartographica Sinica, 2021, 50(10): 1390-1403. DOI: 10.11947/j.AGCS.2021.20200587

閱讀全文:http://xb.sinomaps.com/article/2021/1001-1595/2021-10-1390.htm

引 言

近年來,隨著SAR影像資料在地理國情監測[1]、地表沉降變化檢測[2]等領域發揮的作用越來越顯著,其與光學影像截然不同的成像機理與特性引起學術界和工業界的廣泛關注。結合SAR影像與光學影像各自優勢,實現對大量地表特性資訊的互補,能夠更好地解決變化檢測、目標識別、地物分類等任務。目前SAR影像和光學影像聯合應用的關鍵前提在於影像匹配,影像匹配的本質是在多幅影像之間尋找同名點的過程[3],但是由於SAR影像獨特的成像機理,使其與光學影像之間存在顯著的非線性灰度差異,同時SAR影像還會受到嚴重的相干斑噪聲干擾[4],這些影響因素使光學影像上的顯著特徵點在SAR影像上極不穩定,甚至失效,導致現有的影像匹配技術難以應用於SAR影像和光學影像間的匹配,因此SAR影像和光學影像的匹配技術是目前遙感領域的難點,也是熱點研究問題之一[5-7]。

影像匹配方法主要可分為基於特徵的方法、基於區域的方法[8]和基於深度學習的方法[9-10]。基於特徵的方法透過在輸入的影像之間提取共有特徵,並檢測特徵間的相似性來實現影像匹配。這些影像特徵可以是點特徵[11]、線特徵[12]、面特徵[13]或是區域性不變性特徵(SIFT[14]、SURF[15]等)。為了得到較好的匹配效果,檢測到的影像特徵應具有良好的穩定性、可區分性和可重複性,但是在具有顯著非線性灰度差異的影像之間很難提取到具有高重複率的共有特徵,從而導致匹配不到足夠數量的同名點,使得此類方法在SAR影像和光學影像匹配任務上失敗。

基於區域的方法也被稱為模板匹配方法,透過在影像間設定一定尺寸大小的影像視窗,並選擇某種相似性測度作為檢測影像相似性的準則來實現影像匹配[16]。傳統的模板匹配方法通常是利用影像的灰度資訊進行匹配,代表性的方法有:互資訊(mutual information, MI)[17]、歸一化互相關(normalized cross correlation, NCC)[18]等。由於NCC方法能夠對影像間的線性灰度變化保持穩健,因此被廣泛應用於光學遙感影像匹配,但其對影像間的非線性灰度差異較為敏感。對於MI方法,其本質是依賴於影像灰度的統計資訊進行匹配,與影像間灰度變化的方式相關性較弱,故理論上其對影像間的非線性灰度差異有一定的適應性,然而MI方法忽略了鄰域畫素的影響,使得計算結果容易陷入區域性極值而導致誤匹配,並且其對模板視窗大小比較敏感,匹配過程計算量較大,因此MI方法在SAR影像和光學影像的匹配時效果不佳。

受到深度學習技術的影響,一些基於深度神經網路進行SAR影像和光學影像匹配的方法被提出。文獻[9]提出了一種基於影象風格遷移的匹配方法,透過改進的VGG-19網路模型將SAR影像和光學影像進行風格互換,再利用SIFT或SURF等演算法對互換風格後的影像進行匹配,該方法能夠獲取較多的正確匹配點。文獻[10]改進了一種用於檢測影象相似性的Siamese網路模型[19-20],透過抽取特徵以及去除池化層對原網路進行最佳化,該方法取得了較高的正確匹配率和匹配精度。現階段基於深度學習的方法存在一定的侷限性,首先需要花費大量的時間和精力來製作訓練資料集以及訓練模型,並且由於地表形態構造的多樣性,使得訓練資料集難以具有良好的通用性,導致對於不同型別的地表形態,訓練模型缺乏良好的泛化能力;其次,此類方法的執行效率較低,由於需要將遙感影像輸入到神經網路模型中進行訓練,這個過程需要對海量樣本資料進行迭代計算,對計算環境的軟硬體配置提出挑戰,並且非常耗時,因此這類方法難以達到實際應用的要求,缺乏時效性。

除上述的各種方法之外,近年來,一些研究者發現影像的幾何結構和形狀特徵能夠有效抵抗影像間的非線性灰度差異[21-22],因而將其引入到SAR影像和光學影像的匹配當中,並取得了較好的匹配效果。這類方法不直接利用影像的灰度資訊進行匹配,而是首先利用如影像的梯度、區域性自相似性(local self-similarity, LSS)、相位一致性(phase congruency, PC)等能有效地表達影像結構的資訊來構建特徵描述符,隨後建立描述符之間的相似性測度,並採用模板匹配的策略對影像進行匹配。文獻[23]利用具有對比度和光照不變性的相位一致性特徵對方向梯度直方圖(histograms of oriented gradients, HOG)[24]進行了改進,提出了相位一致性方向直方圖(histogram of orientated phase congruency, HOPC),在光學和SAR影像的匹配任務上取得了較好的效果。但是,HOG和HOPC是在一個稀疏的取樣格網(非逐畫素)內進行特徵構建,是一種相對稀疏的特徵表達方式,難以精確地捕獲影像的細節結構資訊,另外其計算效率較低。文獻[25]利用方向梯度資訊構建了一種稠密結構特徵描述符(channel features of orientated gradients, CFOG), 透過逐畫素地提取鄰域結構特徵,增強了描述符對於結構資訊的細節表達能力,同時在頻率域中完成影像匹配,顯著提高了匹配效能及計算效率。不過,CFOG是利用水平和垂直方向的梯度內插出的方向梯度,其計算精度還可進一步提高。針對這一問題,本文提出一種更精確的方向梯度計算方法,並以此構建特徵描述符進行SAR影像和光學影像的匹配。

本文提出的SOFM方法使用影像的梯度資訊構建出一種表達影像結構的特徵描述符,即角度加權方向梯度AWOG, 隨後選擇描述符之間的差值的平方和(SSD)作為用於匹配的相似性測度,並利用快速傅立葉變換將匹配過程轉換到頻率域進行。設計了一套基於本文方法的自動匹配流程,並透過設計多組試驗來驗證本文方法的有效性和匹配效能。

1 結構特性表達的影像相似性

本節將給出利用影像梯度資訊構建AWOG描述符的詳細步驟,以及給出在頻率域中表達的影像匹配函式的詳細推導過程。

1.1 特徵描述符

AWOG描述符的提出受到HOG[23]和CFOG[25]的啟發。HOG描述符最初被用於處理行人檢測任務,由於對影像結構具有良好的表達能力,其應用範圍被拓展到目標識別[26]、影像分類[27]和影像檢索[28]等領域。CFOG是在HOG的基礎上發展的一種逐畫素的結構特徵描述符,其使用方向梯度資訊來表達影像結構特性,能夠有效抵抗影像間的光照和對比度變化,以及非線性灰度差異。因此,本文同樣選擇利用影像梯度幅值和方向資訊來構建AWOG特徵描述符。

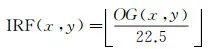

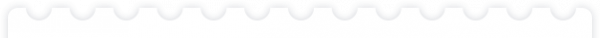

如圖 1所示,對於一幅給定的影像,首先使用x方向的濾波器dx=[-1, 0, 1]和y方向的濾波器dy=[-1, 0, 1]T對影像進行濾波,得到影像在x軸和y軸方向的方向梯度gx和gy。

圖 1 影像梯度方向OG和梯度幅值IG的計算Fig. 1 Computational process of orientation and magnitude of image gradient

圖選項

隨後根據式(1)和式(2)計算影像的梯度幅值IG和梯度方向OG。由於不同型別的感測器所獲取的影像之間存在輻射強度反轉的現象[29],因此為削弱SAR影像和光學影像間因輻射強度反轉所造成的影響,以提高描述符的穩健性,對梯度方向OG進行一步歸化操作[25, 30],根據式(2)計算得到的梯度方向OG其值域為[0°, 360°),將屬於區間[180°, 360°)的值統一減去180°,OG的值域被歸化到[0°, 180°)

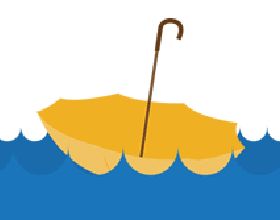

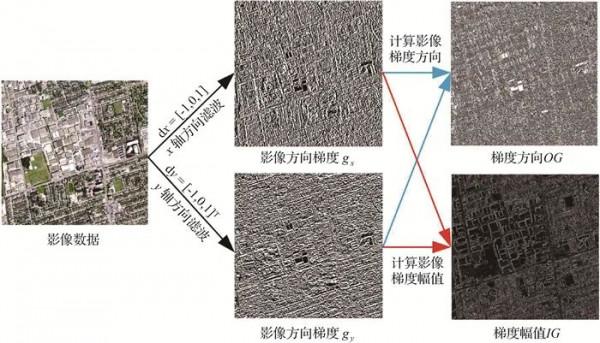

如圖 2所示,按角度間隔為22.5°將OG的值域8等分,等分的區間被9個角度方向所隔開,由於特徵描述符將在這9個角度方向上統計得到,故將它們稱為9個特徵方向,按角度從小到大為9個特徵方向賦予索引號0~8。

圖 2 右特徵方向索引表IRF的構建Fig. 2 Construction of index table IRF

圖選項

對於影像中任意像元p(x,y),其梯度方向值OG(x,y)存在於某兩個特徵方向所構成的角度區間內(極少數恰好位於某特徵方向上,但不影響後續計算),將該角度區間中角度值較大的特徵方向稱為像元的左特徵方向LF,角度值較小的特徵方向稱為像元的右特徵方向RF,根據式(3)進行計算

式中,