11月26日,谷歌翻譯部分搜尋結果被惡意篡改,呈現辱華字樣。

把“艾滋病人”翻譯成“武漢人”,其他艾滋病相關詞彙的翻譯則更加過分,不得不打碼展示。

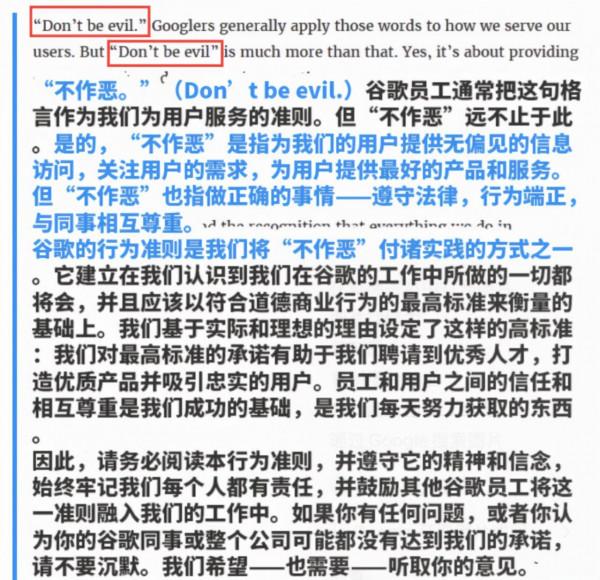

諷刺的是,這是一家自詡“不作惡”(Don't be evil)的公司,而過去幾年谷歌翻譯夾帶私貨的案例數不勝數,曾因使用歧視性詞彙翻譯LGBT詞彙遭到數萬投訴,谷歌因此修改演算法並公開道歉。

直到11月26日23:14,谷歌才宣佈糾正了這次的錯誤,但並未做出更多表示。

那本次谷歌翻譯強行把“艾滋病人”和“武漢人”相關聯的結果是如何產生的呢?很多人出來給谷歌洗地說是被人為修改的結果。

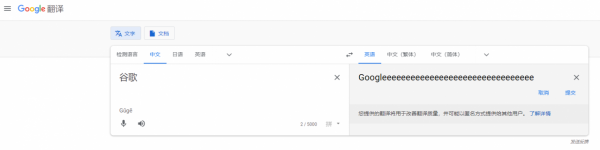

我們在使用谷歌翻譯的時候可以看到右下角有一個“提出修改建議按鈕”。

點選之後便可以對翻譯內容進行任意編輯,這是谷歌提供的人工智慧“學習”功能,當針對同一詞條的翻譯結果出現大量相同的糾錯編輯時,機器就會認為是本詞條翻譯有誤,經過學習之後,將該詞條的翻譯結果替換成糾錯後的內容。

這個洗地的解釋看似很合理,但任何一個官方平臺修改內容都會極其慎重,特別是翻譯類軟體,它的修改結果是對詞條翻譯的重新定義,而各國語言之間的相互翻譯早已在共同使用中達成了約定俗成,不可能在短期內大範圍變動,即使有個別變動,也必須經過嚴格的人工稽核才行。你谷歌數天時間就放出了數十條辱華的相關翻譯結果,說有人工稽核有人會信嗎?也許有這麼一種可能,那就是谷歌翻譯真的有人工稽核,而這些結果就是稽核人員故意放出來的。

我們換個方向想一想,即使這些詞條是人工編輯導致的機器學習烏龍事件,那針對個別詞條如此大規模提交相同的辱華內容肯定不是個人事件,而是有組織有預謀的。

館長想請大家一起來做個測試:開啟谷歌翻譯-中英文互譯-中文輸入“臺灣”-點選“提出修改建議”,把“Taiwan”修改成“Taiwan Province of China”

比人多,比團結,中國人是沒怕過誰的,如果這條修改結果被谷歌接受,那麼就證明此次事件是背後有預謀有組織的行為;如果這條修改結果沒有被谷歌接受,那麼就證明谷歌稽核員是故意放出辱華翻譯結果的。